Doublage et voix-off : cloner et diriger une voix pour son film

Méthode complète de doublage et voix-off avec IA pour cloner, diriger et mixer une voix crédible, sans rendu robotique ni artefacts audio.

Doublage et voix-off IA: cloner et diriger une voix crédible pour son film

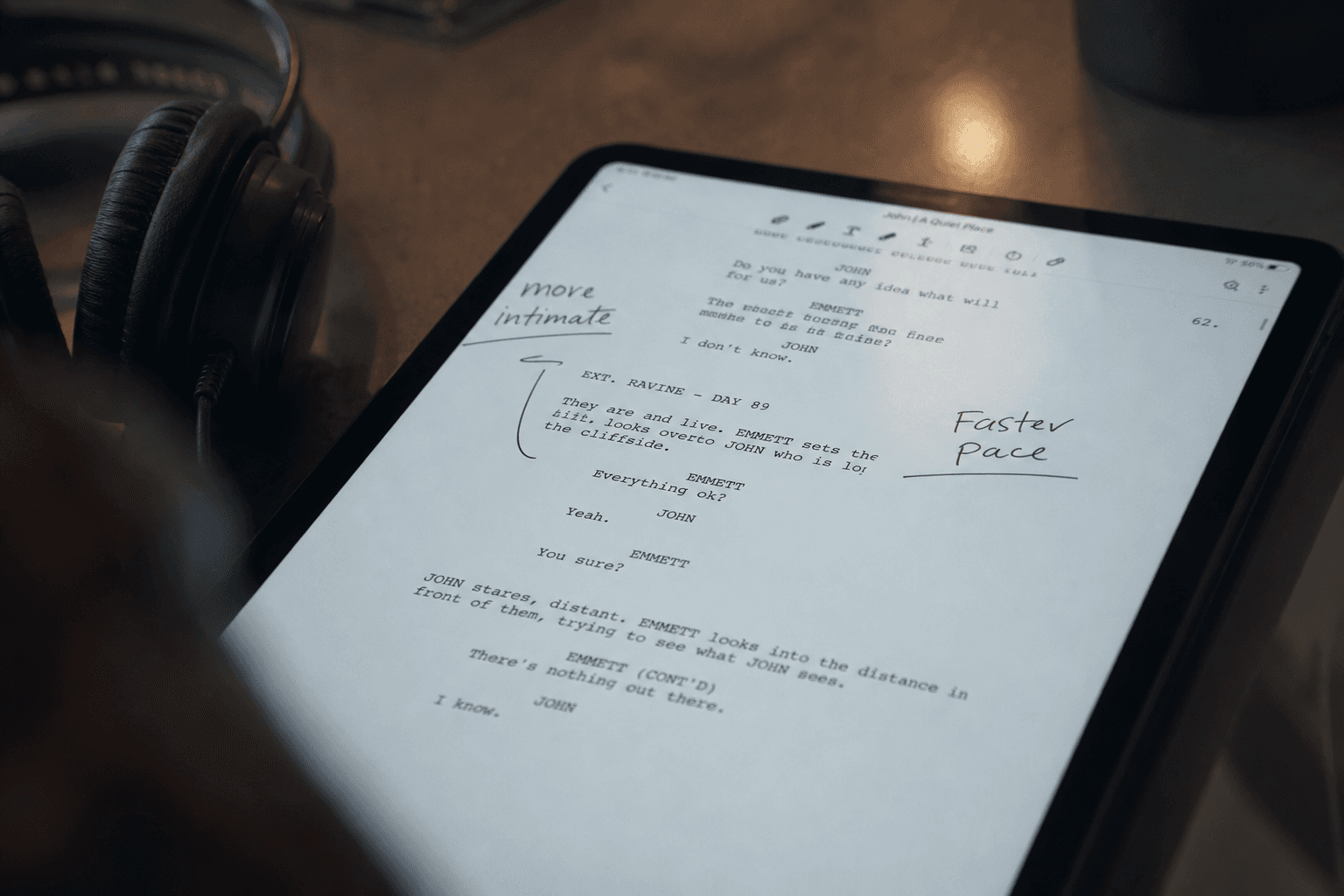

Tu as écrit une super scène. Le cadre est propre. La lumière raconte déjà quelque chose. Puis tu poses une voix IA dessus et tout s’écroule en dix secondes. Ça sonne propre, mais mort. C’est l’erreur la plus fréquente chez les débutants: croire qu’un bon outil de clonage vocal remplace la direction d’acteur.

Je vais être franc. Le doublage et la voix-off IA ne sont pas un bouton magique. C’est une discipline. Tu dois diriger une performance, respirer le texte, contrôler le rythme, et mixer la voix comme un élément de scène. Sinon tu obtiens cette texture "podcast générique" qui ruine la crédibilité d’un film, même quand l’image est magnifique.

La bonne nouvelle, c’est que tu peux apprendre vite. Dans ce guide, je te donne le pipeline que j’utilise en production: préparation de la voix source, génération par blocs d’intention, direction fine de l’interprétation, lip sync propre, puis intégration audio au niveau d’un livrable pro. L’objectif n’est pas juste d’entendre des mots. L’objectif est de faire croire que quelqu’un vit réellement la scène.

Core concepts: ce qui fait une voix IA crédible à l’écran

Une voix IA convaincante repose sur trois piliers. Le timbre, l’intention, et le contexte sonore. Les débutants se focalisent sur le timbre et négligent le reste. Résultat, la voix "ressemble" à la bonne personne mais ne "joue" rien. Pour un spectateur, c’est immédiatement perceptible, même s’il ne sait pas l’expliquer techniquement.

Le deuxième pilier, c’est la prosodie. C’est la musique de la phrase: pauses, accélérations, attaques consonantiques, respirations. Une phrase correcte sur papier peut devenir fausse à l’oreille si son mouvement interne n’est pas maîtrisé. Dans un film, le public lit l’émotion à travers ces micro-variations. Si tu les perds, tu perds la scène.

Troisième pilier, l’intégration acoustique. Une voix doit appartenir à son décor. Une réplique dans une cuisine carrelée n’a pas la même densité qu’une voix intérieure murmurée en plan serré. Beaucoup de rendus IA échouent ici: le texte est clair, mais flotte au-dessus de l’image comme une couche collée après coup.

Quand je forme des créateurs débutants, je leur répète une phrase simple: "Une voix IA crédible, c’est de la direction d’acteur appliquée à l’audio." Tu guides une performance, tu ne valides pas un fichier. Cette posture change tout dans ta manière de travailler, et c’est précisément ce qui te sort du rendu standardisé.

Si tu veux renforcer cette logique côté narration visuelle avant même le sound design, je te conseille notre guide pour créer une narration visuelle sans dialogue. Tu vas mieux comprendre comment la voix doit compléter l’image, pas l’écraser.

| Usage | Objectif | Réglages clés | Erreur fréquente | Fix rapide |

|---|---|---|---|---|

| Voix-off publicité | Clarté + impact rapide | Pace dynamique, compression légère, articulation nette | Voix trop "annonceur radio" | Ajouter intention de scène + pauses naturelles |

| Doublage fiction | Immersion émotionnelle | Variation micro-intensité, respirations contrôlées, room tone cohérent | Diction trop lisse | Réécrire ponctuation de jeu + takes courtes |

| Narration documentaire | Crédibilité + constance | Ton posé, EQ médium clair, sibilance maîtrisée | Monotonie sur 3+ minutes | Segmenter en chapitres d’intention |

| Avatar formation | Intelligibilité continue | Débit stable, consonnes nettes, de-esser modéré | Rendu robotique | Injecter variations fines de rythme |

The trench workflow: pipeline terrain pour cloner et diriger une voix IA

Avant toute génération, tu dois sécuriser le matériau source. Même si l’outil promet un clonage "à partir de 10 secondes", ne travaille pas à l’aveugle. Prépare 2 à 5 minutes de voix propre, dans des intentions variées, avec un micro constant et un niveau stable. L’algorithme apprend mieux un acteur vivant qu’un échantillon parfait mais monotone.

Ensuite, découpe ton script en blocs dramatiques, pas en paragraphes visuels. Un bloc = une intention claire. Exemple: retenue, tension, fragilité, affirmation. Cette segmentation évite les monologues uniformes qui sonnent faux. En pratique, je génère rarement plus de 1 à 3 phrases par passe pour garder un contrôle artistique fin.

À ce stade, pense à ton image. Une voix trop active peut détruire un plan contemplatif. Une voix trop lente peut casser une scène de tension. Tu dois lire la voix avec le montage, pas au casque en solo. Pour ça, j’ouvre toujours la timeline, même en version brouillon, et je teste les répliques dans le flux réel.

Dernière règle de base: garde un journal des prompts et réglages de jeu. Tu notes chaque passe, ce qui fonctionne, ce qui sonne artificiel, ce qui tient au mix. En deux projets, tu constitues ton propre dictionnaire d’intentions. C’est là que tu passes de "je teste des presets" à "je dirige une performance".

Étape 1: préparer une voix source exploitable, pas juste propre

Commence par enregistrer une base vocale avec du silence de début et de fin, à distance micro fixe. Le but n’est pas de faire une performance finale. Le but est de capturer la signature vocale sans pollution acoustique. Si ton espace est imparfait, préfère une prise cohérente et contrôlée à une prise "ultra silencieuse" bricolée avec des plugins destructifs.

Fais parler la voix dans plusieurs couleurs émotionnelles. Une version neutre, une version plus tendue, une version plus intime. Beaucoup de débutants donnent un seul ton à la machine et s’étonnent d’obtenir des sorties plates. Le modèle clone ce que tu lui donnes. Si l’entrée est mono-intentionnelle, la sortie sera mécaniquement monotone.

Prépare aussi le texte pour la synthèse, pas seulement pour la lecture humaine. Ajoute une ponctuation de jeu. Virgules pour respirer, points courts pour couper l’élan, points de suspension quand le souffle doit rester ouvert. Ça change radicalement la musicalité sans toucher à la phrase de fond.

Avant de valider, écoute la source en contexte casque + enceintes simples. Tu dois détecter les sifflantes agressives, les plosives, et les instabilités de niveau. C’est un contrôle de base, mais il t’épargne des erreurs qui se multiplient après clonage.

Étape 2: générer par blocs d’intention avec direction explicite

Tu vas générer chaque bloc comme une mini scène. N’écris pas juste "voix naturelle". Donne une consigne de jeu exploitable: "retenu mais ferme", "fatigué sans être apathique", "urgent sans crier". Une direction vague crée une voix standard. Une direction incarnée crée une voix crédible.

Garde des segments courts. Je recommande 8 à 20 secondes maximum pour les premières passes. Au-delà, tu perds du contrôle sur les micro-inflections. Oui, ça multiplie les exports, mais la qualité grimpe immédiatement. En audio de film, la précision bat toujours la vitesse brute.

Fais au moins trois variantes par bloc. Variante A sécurisée, variante B plus émotionnelle, variante C plus retenue. Ensuite, place-les toutes dans la timeline et choisis avec l’image. Tu verras souvent qu’une version moins démonstrative gagne en vérité au montage.

Nommes tes fichiers intelligemment: sc03_bl02_tension_B_v2.wav. Ce système paraît trivial. En réalité, il te permet de revenir vite sur une intention qui marchait, sans perdre une heure à réécouter vingt exports anonymes.

💡 Frank's Cut: quand une réplique sonne artificielle, diminue le niveau d’émotion demandé. L’IA surjoue facilement. Une intention à 70 pour cent semble souvent plus humaine qu’une intention à 100 pour cent.

Étape 3: aligner doublage et lip sync sans tuer le jeu

Le lip sync est un piège classique. Beaucoup cherchent l’alignement parfait au frame près et détruisent l’interprétation. Dans la vraie vie, la parole est organique. Il existe des micro-décalages naturels. Si tu corriges tout de manière chirurgicale, tu obtiens une bouche correcte et une émotion morte.

Commence par verrouiller les consonnes d’attaque sur les ouvertures labiales majeures. C’est ce que l’œil capte d’abord. Ensuite, ajuste les voyelles longues et les fins de phrase. N’essaie pas de contraindre chaque phonème. Tu veux une illusion crédible, pas une démonstration technique.

Si tu travailles avec un avatar ou un acteur généré, anticipe les limites du moteur. Certaines syllabes rapides passent mal. Réécris alors la phrase pour garder le sens avec une articulation plus stable. Ce n’est pas tricher. C’est de la direction.

Quand tu doutes, coupe court et re-génère la réplique. Beaucoup de débutants passent 40 minutes à micro-éditer une prise médiocre. En production, refaire une passe propre en 5 minutes est souvent plus rentable et plus qualitatif.

Étape 4: mixer la voix pour qu’elle appartienne réellement à la scène

Une voix propre n’est pas une voix intégrée. Pour qu’elle vive dans le plan, travaille ton EQ de manière minimale mais ciblée. Allège les graves boueux, clarifie les médiums utiles à l’intelligibilité, et calme les aigus agressifs sans étouffer l’air. Chaque scène demande un équilibre différent.

Compression ensuite, mais avec retenue. Tu veux stabiliser la diction, pas écraser les dynamiques émotionnelles. Une voix trop compressée devient plate, fatigante, et artificiellement "broadcast". En fiction, c’est souvent la respiration des micro-variations qui porte la vérité du jeu.

Ajoute une réverbération cohérente avec le décor, très discrète. Une petite pièce, un couloir, un extérieur urbain humide, ce ne sont pas les mêmes signatures. Si ta reverb est audible en tant qu’effet, c’est souvent déjà trop. Le spectateur ne doit pas entendre le plugin. Il doit croire au lieu.

Finalise avec un contrôle de contexte. Teste la voix avec la musique, les ambiances, et les effets. Une voix superbe en solo peut disparaître sous un design sonore dense. Je recommande de vérifier la lisibilité sur téléphone et laptop, pas seulement en monitoring studio.

[🎥 WATCH: Check out this breakdown on the Business Dynamite YouTube channel: https://www.youtube.com/@BusinessDynamite - Specifically look at the segment on directing AI voice performance for film dubbing]

Troubleshooting: ce que les débutants cassent en doublage IA et comment réparer

Premier problème massif, la monotonie. Tu génères un long texte en une passe et toute la voix garde la même énergie. La correction est immédiate: segmente en blocs d’intention et réinjecte des variations de rythme. Même une variation légère de débit entre deux phrases peut suffire à rendre la performance crédible.

Deuxième casse, les sifflantes agressives et consonnes percussives. Cela arrive souvent quand on pousse trop la clarté en post. Solution: de-esser modéré, contrôle des transitoires, et diction source mieux calibrée. Ne cherche pas à corriger uniquement au mix ce qui est déjà déséquilibré dans la génération.

Troisième erreur fréquente, la voix détachée du décor. Elle est nette, mais flotte. Pour réparer, pose un room tone cohérent, ajuste la réverb selon l’espace visuel, puis recale le niveau de voix dans la dynamique globale de la scène. L’intégration acoustique vaut autant que la qualité du timbre.

Quatrième problème, lip sync rigide. Les mots collent mais la performance paraît mécanique. Ici, il faut accepter un léger naturel de décalage, retravailler l’intention, et parfois simplifier la phrase. Le public pardonne une micro-imperfection labiale. Il ne pardonne pas une émotion fausse.

Cinquième piège, vouloir cloner une célébrité ou une voix identifiable sans cadre légal. C’est une bombe juridique pour un projet pro. Utilise des voix autorisées, documente tes droits, et maintiens une traçabilité claire des sources audio. Si tu monétises ton contenu, cette discipline est non négociable.

Pour approfondir la partie légale et commerciale autour de la production IA, tu peux lire notre guide sur la vente de vidéos IA à des clients professionnels. Et si tu veux structurer ton projet complet de la scène au rendu final, reprends notre workflow complet idée film IA réaliste.

💡 Frank's Cut: en cas de doute artistique, choisis toujours la prise qui sert le personnage plutôt que la prise techniquement la plus "propre". Un film se gagne sur l’émotion, pas sur la perfection clinique.

Références externes solides pour progresser sans bruit

Évite de bâtir ton workflow sur des extraits viraux sans méthode. Pour comprendre les bases techniques du niveau et du loudness, la recommandation EBU R128 reste une référence sérieuse. Pour les standards de diffusion plus larges, les recommandations ITU-R BS.1770 donnent un cadre utile. Côté édition et postproduction, la documentation DaVinci Resolve Fairlight aide à structurer une chaîne audio propre.

"Le vrai test d’une voix IA, ce n’est pas de savoir si elle impressionne en solo. C’est de voir si elle disparaît dans l’histoire."

FAQ: les vraies questions avant de cloner une voix pour un film

-

Combien de minutes de voix source faut-il pour un clonage vraiment crédible ?

En pratique, je recommande au minimum 2 à 5 minutes de voix propre, avec plusieurs intentions de jeu. Oui, certains outils annoncent des résultats avec quelques secondes, mais la stabilité émotionnelle et la cohérence prosodique sont souvent faibles. Plus ton corpus est diversifié et contrôlé, plus tu obtiens une voix exploitable en production. Il vaut mieux 3 minutes bien enregistrées avec des variations naturelles qu’un long enregistrement monotone. Pense qualité de matière, pas volume brut. C’est cette base qui conditionne tout le reste du pipeline. -

Quelle est la différence entre voix-off IA et doublage IA ?

La voix-off IA commente ou guide, souvent hors champ, avec une exigence de clarté prioritaire. Le doublage IA, lui, doit s’aligner à la performance visuelle d’un personnage et respecter le rythme des lèvres, des respirations, et des intentions dramatiques. En voix-off, une légère stylisation peut fonctionner. En doublage fiction, cette stylisation devient vite artificielle si elle n’est pas ancrée dans le jeu. Les deux disciplines utilisent des outils proches, mais les critères de validation sont différents. Mélanger les deux approches est une source fréquente de rendu incohérent. -

Comment éviter que la voix clonée sonne robotique même avec un bon modèle ?

Le rendu robotique vient rarement d’un seul paramètre. Il provient d’un combo: texte trop littéral, absence de ponctuation de jeu, génération de blocs trop longs, et compression excessive au mix. Pour corriger, segmente tes phrases, écris des respirations intentionnelles, et dirige la performance avec des consignes concrètes. Ensuite, garde une dynamique naturelle en postproduction. Une voix trop nivelée perd son humanité. Enfin, valide toujours avec l’image: ce qui semble neutre en solo peut devenir faux en contexte de scène. -

Faut-il écrire le script différemment pour la synthèse vocale IA ?

Oui, clairement. Un script prévu pour lecture humaine silencieuse n’est pas toujours adapté à la synthèse. Tu dois clarifier les ruptures, simplifier certaines formulations, et ajouter une ponctuation qui guide l’intonation. Cela ne veut pas dire appauvrir ton texte. Cela veut dire écrire pour l’oreille, pas seulement pour les yeux. Je conseille de relire chaque réplique à voix haute et d’ajuster jusqu’à sentir un rythme naturel. Ce travail éditorial en amont réduit fortement les retakes et améliore la crédibilité finale. -

Comment intégrer la voix IA avec la musique sans perdre l’intelligibilité ?

La clé, c’est l’équilibre fréquentiel et dynamique. Si la musique occupe les médiums où vit la voix, tu perds la compréhension, même à volume correct. Commence par clarifier la voix avec un EQ léger, puis crée de la place dans la musique, souvent via une atténuation ciblée autour des zones critiques de la diction. Ensuite, ajuste la compression de façon musicale, pas agressive. Enfin, teste sur des systèmes variés. Une voix lisible au studio peut devenir noyée sur smartphone. Le contrôle multi-support reste indispensable. -

Est-ce que le lip sync doit être parfaitement calé pour paraître réel ?

Pas forcément. Ce qui paraît réel, c’est un alignement crédible des moments clés, surtout les attaques consonantiques et les ouvertures de bouche marquantes. Vouloir caler chaque phonème de façon chirurgicale peut produire un résultat rigide et artificiel. Il vaut mieux viser une synchronisation vivante qu’un verrouillage mécanique. Dans une vraie performance humaine, de micro-décalages existent. Le spectateur les accepte. Ce qu’il refuse, c’est une bouche parfaite avec une émotion absente. Priorise toujours l’intention dramatique avant la précision obsessionnelle. -

Quels risques légaux faut-il anticiper avant de publier une voix clonée ?

Tu dois sécuriser les droits de la voix source, vérifier les conditions d’usage de l’outil, et documenter les consentements si une voix réelle est impliquée. Publier ou vendre un contenu avec une voix clonée sans cadre clair peut entraîner des litiges sérieux, même si la qualité technique est excellente. En contexte pro, conserve une trace de tes licences, versions d’outil, et fichiers source. Cette rigueur protège ton activité et rassure les clients. Le juridique n’est pas un détail administratif, c’est une partie de la qualité globale du projet. -

Quel protocole rapide appliquer quand on débute et qu’on veut un résultat propre en une session ?

Fais un sprint de 90 minutes structuré. 20 minutes de préparation de voix source et script ponctué, 35 minutes de génération en blocs avec trois variantes par réplique clé, 20 minutes d’intégration timeline et lip sync, puis 15 minutes de mixage de base et contrôle multi-support. À la fin, garde une version "safe" publiable et une version "ambitieuse" pour test. Ce cadre t’empêche de tourner en rond. Il crée des décisions nettes, mesurables, et te fait progresser projet après projet.

Continuer la lecture

Comment améliorer un rendu moyen en rendu pro

Un plan vidéo IA correct ne suffit pas sur un écran sérieux : diagnostic par couches, chaîne de post solide, upscaling maîtrisé et discipline de rejet pour passer d'un rendu moyen à un rendu pro sans magie ni promesses trompeuses.

Comment transformer une vidéo IA en publicité premium

Méthode complète pour transformer une vidéo IA en publicité premium : cadre créatif orienté conversion, cohérence visuelle disciplinée, post-production sérieuse et contrôle qualité média comme une agence. Le mot-clé transformer vidéo IA publicité premium devient ici une check-list exécutable.

Comment mixer audio et image pour un rendu cinéma

Mixer audio et image pour un rendu cinéma sur vidéo IA : hiérarchie sonore, stems, dynamique, spatialisation, calibration avec l’étalonnage et livraison sans fatigue ni sensation « démo ».