Comment utiliser l'IA générative de Photoshop (Firefly) pour étendre ses plans

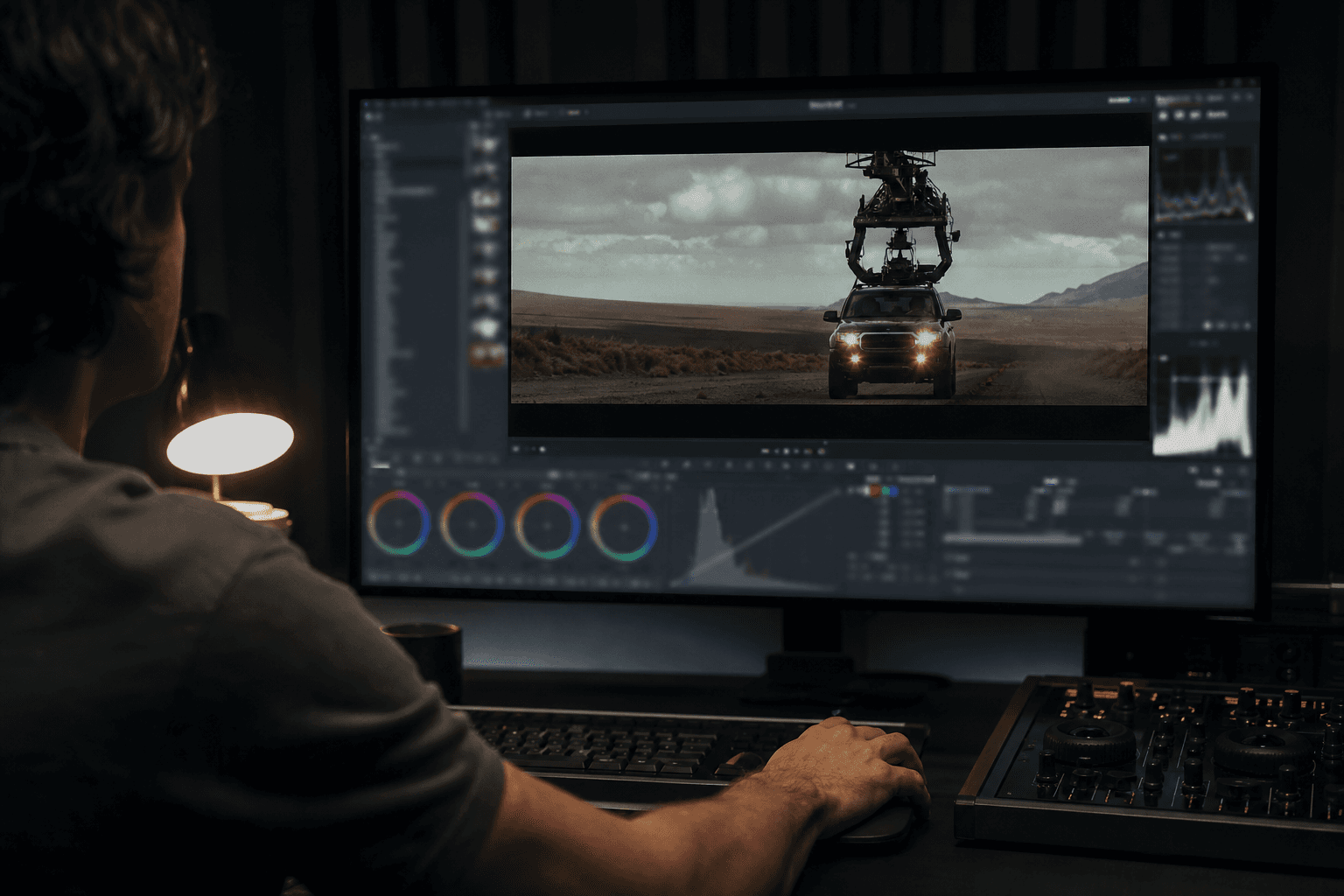

Masterclass pratique pour étendre des plans avec Photoshop Firefly sans casser perspective, lumière et continuité visuelle.

Comment utiliser l'IA générative de Photoshop (Firefly) pour étendre ses plans

Tu as un plan fort. Belle compo, bonne émotion. Puis tu dois l’adapter en 16:9, en vertical, en version safe title pour YouTube, et tout part en vrille. L’extension générative invente des murs impossibles, des textures plastiques, et des lignes qui trahissent immédiatement le fake. C’est exactement le mur que prennent tous les débutants sur Firefly.

Le point clé : Firefly est excellent pour étendre un plan si tu traites l’outil comme un assistant VFX, pas comme une baguette magique. Le vrai levier est ta préparation du cadre, ta méthode de sélection, et ta discipline de correction locale. Ce guide te donne un workflow propre pour étendre des plans sans perdre le rendu cinéma.

Ce qui fait une extension de plan crédible avec Firefly

Le premier principe est la géométrie. Firefly peut générer de la matière convaincante, mais il n’invente pas une perspective réaliste si ton cadre de départ est ambigu. Tu dois identifier les lignes de fuite, l’horizon et les masses dominantes avant d’étendre.

Le second principe est la lumière. Les extensions ratées ont souvent une exposition correcte mais une logique de lumière incohérente. Direction de key light, intensité des ombres, température globale: ces éléments doivent rester constants, sinon le spectateur sent la rupture en moins d’une seconde.

Le troisième principe est la texture. Une extension “trop propre” se voit immédiatement. Tu dois harmoniser grain, netteté et micro-contraste avec l’image source. C’est ce qui transforme un patch IA en continuité visuelle.

Le quatrième principe est la retenue. L’extension est un outil de cadrage, pas un redesign total. Plus tu demandes à Firefly de reconstruire un monde complet, plus le risque d’artefacts grimpe.

Workflow de tranchée: étendre un plan sans le détruire

Étape 1: préparer le plan source comme un élément VFX

Commence par nettoyer ton image source avant toute extension. Retire les défauts évidents, corrige les dominantes extrêmes, et verrouille une exposition stable. Un plan mal préparé produit des extensions fragiles.

Ensuite, duplique ton calque et travaille en non destructif. Crée une marge de canvas selon ton objectif final: horizontal vers vertical, vertical vers horizontal, ou simple breathing room pour recadrage.

Définis l’intention de l’extension en une phrase: “J’ajoute de l’espace de respiration à gauche sans attirer l’oeil.” Cette phrase t’empêche de surgénérer.

Enfin, crée un masque de protection sur les zones critiques du sujet (visage, mains, bords de silhouette). Firefly doit travailler autour du sujet, pas réinventer son identité.

Étape 2: générative fill avec prompts orientés continuité

Sélectionne la zone d’extension par blocs simples. Évite les sélections hyper complexes au départ. Tu veux d’abord stabiliser les volumes principaux.

Utilise des prompts descriptifs concrets, pas des adjectifs vagues. Exemple: “mur béton brut légèrement usé, lumière douce venant de droite, texture réaliste, contraste modéré.”

Génère plusieurs variations, puis compare uniquement sur trois critères: perspective, lumière, matière. La variante “la plus jolie” n’est pas toujours la plus raccord.

Ne valide pas trop vite. Fais un zoom 100% sur les jonctions. Si la texture est trop différente du plan source, tu corriges immédiatement en passe locale.

💡 Frank's Cut: fais toujours une première extension sans prompt (prompt vide), puis une seconde avec prompt. Souvent, la base sans prompt donne une continuité plus naturelle que la version surdirigée.

Étape 3: correction locale pour invisible seam

Une fois la base validée, passe en correction fine. Utilise des masques doux pour fondre les transitions de texture. Le but est d’éliminer toute “couture visuelle” entre source et extension.

Ajuste la luminance locale des zones générées. Même une différence de 5% peut trahir l’intervention IA sur un écran calibré.

Ajoute ensuite un grain subtil harmonisé sur l’image complète. Jamais uniquement sur la zone générée. Le grain global unifie la perception.

Si nécessaire, applique une légère réduction de netteté sur l’extension pour matcher la profondeur de champ d’origine.

Étape 4: export multi-usages sans repasser par zéro

Prépare des masters selon usages: 16:9, 9:16, 1:1. Garde toujours un PSD maître avec groupes nommés (source, extension, correction_lumiere, grain_global).

Teste tes exports sur mobile et desktop. Une extension qui passe en plein écran peut casser en format social compressé.

Documente ton prompt et la version retenue dans un fichier notes. Tu pourras reproduire rapidement le même rendu sur les autres plans de la séquence.

Intègre enfin l’image dans ton workflow global de postprod. Si tu utilises un pipeline cohérent, lis aussi notre guide complet sur les modèles Flux, notre méthode d’étalonnage pour vidéos IA, notre protocole de continuité visuelle, et notre check-list raccords et continuité.

Tableau comparatif: extension rapide vs extension pro

| Approche | Temps | Risque artefacts | Cohérence lumière | Qualité diffusion |

|---|---|---|---|---|

| Extension one-shot sans masque | Très rapide | Élevé | Faible | Faible à moyenne |

| Extension par blocs + prompts | Moyen | Moyen | Bonne | Bonne |

| Extension + correction locale + grain global | Plus long | Faible | Élevée | Élevée |

Troubleshooting: ce que les débutants cassent le plus

Erreur 1: demander une extension trop large d’un coup. Fix: découper en zones successives.

Erreur 2: ignorer la direction lumière. Fix: annoter key light avant génération.

Erreur 3: texture trop propre. Fix: harmonisation grain et micro-contraste.

Erreur 4: sujet touché par la génération. Fix: masque de protection strict.

Erreur 5: pas de vérification format final. Fix: test 16:9 + 9:16 avant validation.

[🎥 WATCH: Check out this breakdown on the Business Dynamite YouTube channel: https://www.youtube.com/@BusinessDynamite - Specifically look at the segment on cinematic frame extension workflows].

Extensions selon le type de plan (portrait, architecture, nature)

Toutes les images ne réagissent pas pareil au Generative Fill. Sur un portrait serré, le danger principal est la dérive du visage et des mains : tu dois verrouiller la silhouette avant même de penser au décor. Sur une architecture, la géométrie impose une progression par bandes horizontales ou verticales qui suivent les lignes du bâtiment ; une sélection “libre” qui coupe une fenêtre au milieu produit presque toujours une symétrie bizarre ou un reflet qui ne correspond à aucune source. Sur une scène naturelle avec feuillage, le grain et la micro-variation sont tes amis : là où les débutants sharpenent, les pros harmonisent et ajoutent une texture résiduelle cohérente avec le capteur simulé dans ton brief.

Quand tu prépares une série pour plusieurs ratios (YouTube, reels, vignette boutique), travaille à partir du master le plus large et réduit ensuite. Étendre plusieurs fois à partir d’un fichier déjà recadré accumule les artefacts aux bords successifs. Si tu dois livrer un 16:9 et un 9:16 à partir d’un 4:5, considère deux masters intermédiaires plutôt qu’une chaîne de cinq passes IA sur les mêmes pixels. Pour les textes incrustés (titres safe zone), garde une marge réelle dans Photoshop avec des guides : Firefly ne lit pas ton grille After Effects ; c’est à toi d’anticiper où la lisibilité doit rester intacte.

Enfin, relie ce workflow aux autres guides du site quand tu mixes IA pure et postprod classique : la continuité entre plusieurs plans, le passage d’une image IA à une vidéo crédible, et le choix entre approches photoréalistes et stylisées pour ne pas mélanger deux philosophies de rendu dans une même séquence.

Brief léger avant chaque session Firefly

Note cinq lignes dans un fichier texte collé au dossier PSD : ratio final, direction de la lumière observée sur le master, distance focale « plausible », liste des zones interdites à la génération, et le niveau de grain de référence sur une capture du plan source. Cette mini-fiche évite la dérive où tu réessaies au hasard parce que tu as oublié ta propre contrainte principale. Elle sert aussi à quelqu’un d’autre qui rouvre le projet trois semaines plus tard.

Quand préférer une extension « géométrique » à une extension « descriptive »

Sur des surfaces régulières (mur intérieur lisse, ciel dégagé modéré, route asphaltée), commence par une extension sans prompt pour laisser Firefly interpoler la répétition structurelle. Sur des motifs riches (brique ancienne, vitrail, rayures irrégulières), ajoute vite un prompt qui nomme la matière et l’échelle des motifs, sinon le modèle invente une version trop régulière qui se lit comme une texture procédurale. Si tu hésites entre deux stratégies, fais une passe courte sur une bande étroite du cadre avant d’engager toute la hauteur : tu valides la logique sans payer le coût cognitif d’un grand masque raté.

FAQ

Foire aux questions

Réponses rapides aux questions les plus fréquentes sur cet article.

Firefly peut-il remplacer un vrai décor en postproduction ?

Firefly peut étendre efficacement un décor existant, mais il ne remplace pas une direction artistique complète quand la scène demande une reconstruction complexe. Sur des extensions de cadre raisonnables, les résultats peuvent être très propres. Sur des reconstructions massives, les incohérences de perspective et de lumière deviennent plus probables. Le bon usage est d’ajouter de l’espace narratif autour d’un plan solide, pas de transformer totalement l’environnement. Pense “extension ciblée” plutôt que “reconstruction globale”.

Quelle taille d’extension est la plus sûre pour débuter ?

Pour débuter, vise des extensions de 10 à 25% du cadre sur un côté, puis valide. Cette plage permet de garder une logique visuelle forte sans forcer le modèle à inventer trop de structure. Si tu dois étendre davantage, fais-le en plusieurs passes avec contrôles intermédiaires. Plus l’extension est brutale, plus le risque de rupture matière/lumière augmente. Les meilleures pipelines pro avancent en petits incréments, avec validation continue.

Faut-il toujours écrire un prompt pour Generative Fill ?

Non. Dans beaucoup de cas, surtout sur fonds simples, un prompt vide donne une continuité plus naturelle car Firefly extrapole directement le contexte visuel. Le prompt devient utile quand tu veux guider un matériau spécifique ou une direction de lumière précise. La bonne méthode est comparative : version sans prompt, puis version avec prompt, puis choix sur critères objectifs (perspective, texture, lumière). Ne suppose jamais qu’un prompt long fera mieux.

Comment éviter les bords visibles entre source et extension ?

Utilise des sélections progressives, corrige localement la luminance, puis unifie le grain sur l’ensemble du plan. Les bords visibles viennent souvent d’un contraste local différent, pas d’un “mauvais modèle”. Une passe dodge/burn légère peut suffire à rendre la transition invisible. Évite aussi les sélections trop dures en lignes droites sur des textures organiques. Le blending réaliste est un travail de finition, pas seulement une génération.

Firefly est-il adapté à un workflow vidéo de film ?

Oui, surtout pour préparer des keyframes ou des plans fixes utilisés dans un pipeline vidéo plus large. Il fonctionne très bien pour recadrages, extensions de matte et variations de format. Pour des séquences animées, tu dois ensuite gérer la cohérence temporelle avec d’autres outils et un montage rigoureux. Firefly est une brique très utile, pas un pipeline vidéo complet à lui seul.

Quels formats exporter pour garder de la flexibilité ?

Garde toujours un master PSD avec calques nommés, puis exporte en TIFF ou PNG selon ton pipeline. Pour diffusion, dérive des formats compressés à partir d’un master propre, jamais l’inverse. Si tu travailles multi-plateformes, prépare les ratios principaux dès la phase d’extension. Cette anticipation évite de relancer des générations au dernier moment quand un recadrage social casse la composition.

Références externes utiles

Pour des bases fiables, consulte la documentation Adobe Firefly, les guides Adobe Photoshop, et les analyses de workflow de Frame.io Insider.

Approfondissement terrain

Comment utiliser l'IA générative de Photoshop (Firefly) pour étendre ses plans : ce chapitre prolonge l’angle « Masterclass pratique pour étendre des plans avec Photoshop Firefly sans casser perspective, lumière et continuité visuelle. » pour le sujet réel derrière photoshop-firefly-etendre-plans-ia-generative. L’objectif n’est pas d’empiler des adjectifs, mais d’installer une boucle QA courte que tu peux réutiliser sur chaque livrable : capture, note, compare, tranche, archive. La plupart des créateurs perdent du temps parce qu’ils mélangent trois variables en une session, puis blâment le modèle. Quand tu sépares lumière, composition, texture, intention, tu retrouves un diagnostic honnête et une progression mesurable.

Protocole « une variable » (30 minutes)

Minute 0 à 5 : écris la phrase « ce que le spectateur doit croire sans légende ». Minute 5 à 12 : liste trois preuves visuelles possibles (ombre portée, prop d’usage, reflet cohérent). Minute 12 à 22 : génère deux images qui ne diffèrent que par une de ces preuves. Minute 22 à 28 : teste en miniature mobile et en plein écran. Minute 28 à 30 : choisis A ou B et nomme le critère gagnant dans le fichier projet. Ce protocole évite la dérive où chaque regen change tout sauf le problème initial.

Scénarios A, B, C avec pivot

Scénario A. Rendu trop propre, trop vitrine. Pivot : ajoute une trace d’usage localisée et une lumière latérale plus marquée, sans toucher au sujet si la géométrie est bonne. Scénario B. Image chargée sans hiérarchie. Pivot : retire deux objets du prompt, recentre le contraste sur le sujet, ou resserre le cadrage. Scénario C. Image spectaculaire mais froide. Pivot : baisse légèrement la saturation globale, ajoute un grain fin homogène en post, puis regénère seulement si la géométrie ou la perspective ment encore.

Trench warfare : dix pièges fréquents

- Tout corriger en même temps. Tu ne sais plus ce qui a sauvé l’image.

- Comparer seulement en plein écran. Le mobile trahit souvent le faux luxe.

- Ignorer le rythme en amont vidéo. Même en amont, pense au découpage et à la respiration des plans.

- Copier-coller des prompts sans brief local. Les mots doivent coller à ton sujet réel.

- Sharpen global agressif. Les contours criards lisent « numérique ».

- Trop d’adjectifs contradictoires. Une intention dominante suffit au début.

- Pas de fichier texte d’archive. Tu perds seed, version, et raison du choix.

- Valider fatigué. La fatigue rend « beau » ce qui est seulement familier.

- Multiplier les modèles le même jour. Tu compares des chaînes différentes, pas des réglages.

- Livrer sans A/B. Le client ou toi futur ne saura pas ce qui était acceptable.

Tableau de décision rapide

| Si tu observes | Action prioritaire |

|---|---|

| incohérence lumière | simplifier les sources |

| sujet noyé | cadrage ou hiérarchie de contraste |

| texture plastique | grain fin ou moins de HDR |

| mains impossibles | hors champ ou action triviale |

| décor catalogue | micro usure et prop fonctionnel |

| ciel vide | volume nuageux ou brume motivée |

| reflets impossibles | réduire les sources contradictoires |

Atelier client ou commanditaire

Même pour toi-même, rédige un mini brief : public, canal, durée de lecture attendue, interdits (violence, marques, visages réels). Pour une équipe, ajoute une colonne « preuve de conformité » : capture des CGU du service, version du modèle, date d’export. Cette colonne te sauve quand un diffuseur demande d’où vient l’image.

Questions récurrentes (atelier)

Dois-je livrer deux versions ? Oui, A et B avec une phrase de différence nommée, sinon la discussion reste floue. Faut-il documenter les prompts ? Oui, même partiellement : c’est ton assurance qualité interne. Que faire si le modèle change ? Fixe un brief test et compare avant de poursuivre une série. La retouche manuelle triche-t-elle ? Non si tu assumes la chaîne et les limites contractuelles. Combien de temps par image sérieuse ? Souvent plus long en validation qu’en génération brute, prévois-le au devis. Faut-il une cible technique ? Oui : résolution finale, espace colorimétrique, marge sur hautes lumières si compression sociale. Et la propriété intellectuelle ? Vérifie les CGU et les droits sur les références incluses dans le prompt.

Poste de contrôle multi-écrans

Chaîne minimale : moniteur principal, laptop standard, smartphone. Si tu n’as que deux écrans, envoie un export test sur ton téléphone via un canal propre (pas un messager qui recompresse à l’infini). Note la différence perçue sur les peaux, les contours, et les micro-contrastes. Beaucoup d’images « IA » le deviennent surtout après une deuxième compression involontaire.

Liens internes utiles

Croise avec pourquoi ton prompt ne marche pas, et comment le corriger, les erreurs de prompt qui rendent une image IA artificielle, et comment contrôler le style visuel dans une génération IA. Si ton sujet touche la vidéo, relie aussi à comment structurer une vidéo IA comme un vrai film et à comment améliorer le réalisme des mouvements en vidéo IA.

Journal de fin de session (modèle)

Date :

Slug / fichier :

Hypothèse du jour :

Variable testée :

Résultat A vs B :

Décision :

Prochain test :

Synthèse opérationnelle

Pour photoshop-firefly-etendre-plans-ia-generative, retiens trois lignes dans ton carnet : intention en une phrase, loi lumière en une phrase, preuve matérielle en une phrase. Si l’une manque, tu n’es pas prêt à regénérer massivement : tu es prêt à diagnostiquer. La qualité long terme vient de cette discipline, pas du dernier modèle sorti mardi.

Continuer la lecture

Comment améliorer un rendu moyen en rendu pro

Un plan vidéo IA correct ne suffit pas sur un écran sérieux : diagnostic par couches, chaîne de post solide, upscaling maîtrisé et discipline de rejet pour passer d'un rendu moyen à un rendu pro sans magie ni promesses trompeuses.

Comment transformer une vidéo IA en publicité premium

Méthode complète pour transformer une vidéo IA en publicité premium : cadre créatif orienté conversion, cohérence visuelle disciplinée, post-production sérieuse et contrôle qualité média comme une agence. Le mot-clé transformer vidéo IA publicité premium devient ici une check-list exécutable.

Comment mixer audio et image pour un rendu cinéma

Mixer audio et image pour un rendu cinéma sur vidéo IA : hiérarchie sonore, stems, dynamique, spatialisation, calibration avec l’étalonnage et livraison sans fatigue ni sensation « démo ».