Pipeline complet image vers vidéo avec l'IA

Du brief à la livraison : chaîne image pilote, animation IA, contrôle qualité, post et son pour un pipeline complet image vers vidéo crédible, sans surprises ni nuits blanches.

Pipeline complet image vers vidéo avec l'IA

Tu poses une image magnifique sur la timeline. Tu passes en mode vidéo. Tu crois avoir terminé le travail difficile.

Et puis la deuxième seconde arrive.

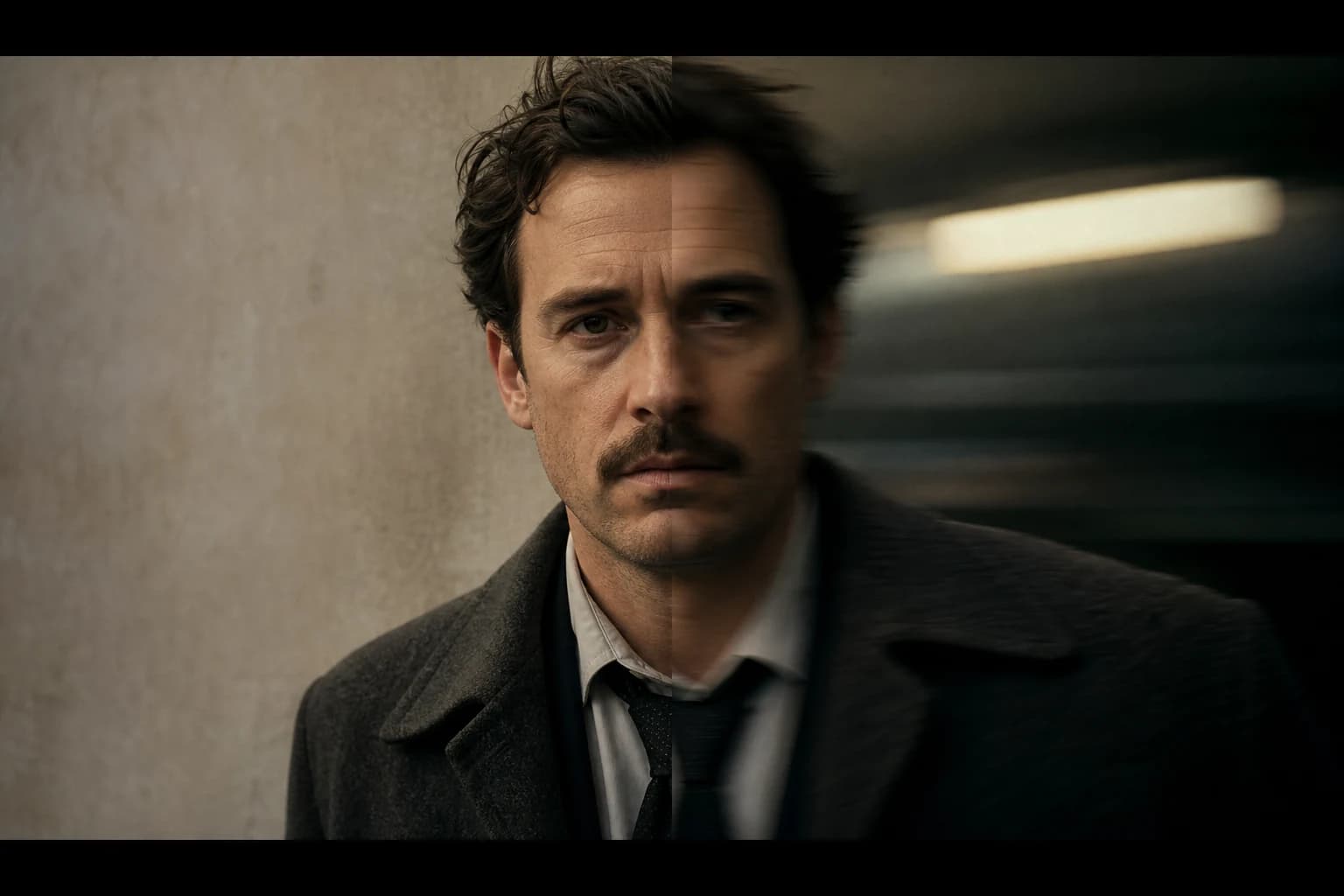

La veste change de ton, la fenêtre « respire », les yeux perdent leur axe. Ton clip ne ressemble plus à une séquence de cinéma : il ressemble à une démo qui essaie trop fort. Ce n'est pas une malédiction. C'est le symptôme classique d'un trou dans ton pipeline complet image vers vidéo IA.

Un pipeline complet image vers vidéo IA, ce n'est pas une chaîne d'outils collés avec de la colle créative. C'est une suite de décisions documentées : intention régie, image pilote honnête, traduction du still en mouvement minimal, protocole de rejet, post qui respecte la lumière, son qui vend la matière, export qui assume une compression réelle. Ce guide est la version terrain que je donne aux équipes qui veulent livrer des plans utilisables, pas des surprises dans un dossier client.

La différence entre quelqu'un qui « teste des IA » et quelqu'un qui produit tient à une chose simple : chaque étape a une sortie nommée. Si tu ne peux pas retrouver la pilote qui a servi à la prise la plus stable, tu ne fais pas du pipeline. Tu fais du bricolage avec une timeline.

Ce que « pipeline complet » change face au bouton « animate »

Voici la vérité qui déplaît aux optimistes : la vidéo IA ne répare pas une image menteuse. Elle amplifie les tensions déjà présentes. Une peau trop lisse avec un décor hyper détaillé devient une oscillation temporelle. Une main presque bonne devient un accident visuel en plan serré.

Quand je parle de pipeline complet image vers vidéo IA, je parle d'une discipline de plateau virtualisée. Tu écris un brief comme si tu avais une équipe technique dans le couloir. Tu verrouilles une pilote comme si tu brûlais une bonnette sur objectif. Tu animes comme si tu payais une minute de moteur au prix d'une minute d'attention humaine.

Le bouton « animate » promet la magie. Le pipeline promet la répétabilité. Et la répétabilité, sur un projet sérieux, vaut plus qu'un clip viral isolé.

Les équipes qui ratent le passage image vidéo ont souvent une même erreur : elles confondent beauté du still et stabilité temporelle. Une frame peut être sublime et pourtant hostile au mouvement si les contours du visage sont trop « propres », si les cheveils sont trop nets contre une matière floue, ou si la profondeur de champ est contradictoire avec ce que tu vas demander comme travelling.

Le pipeline impose une question avant le rendu : « Qu'est-ce qui doit rester invariant ? » Identité du sujet, costume, géométrie du décor critique, lecture de la lumière : tu listes trois invariants minimum. Tout le reste est négociable.

Une autre confusion fréquente : croire que « plus de résolution au départ » sécurise la vidéo. Grossir une pilote qui ment, c'est grossir le mensonge. Tu itères en résolution modeste jusqu'à ce que le mouvement soit acceptable, puis tu montes quand la direction est validée. Sinon tu passes tes journées à stabiliser des artefacts en 4K.

Enfin, le pipeline complet inclut la livraison. Si tu valides sur un moniteur large sans tester compression mobile, tu prépares une désillusion client. La chaîne de diffusion fait partie du rendu, pas du bonus.

Les quatre couches que tout pipeline sérieux doit nommer

Couche A : intention. Une phrase de plateau et cinq lignes max : sujet, lieu, heure lumière, action unique, interdits. Pas trois actions simultanées : le modèle choisira celle qu'il sabotera en frame quarante.

Couche B : image pilote. C'est ton cadre de référence spatial et lumineux. Tu exportes en PNG de qualité, tu archives prompt et seed dans notes.txt, tu refuses les pilotes qui mentent sur les mains ou la bouche si tu vises un gros plan.

Couche C : mouvement. Traduction du still en consigne temporelle courte : une intention caméra, une micro vie du sujet, durée modeste. Si tu demandes orbite plus vent plus cheveux au vent plus dialogue plus main qui tourne une page, tu construis une bombe à fragmentation.

Couche D : finition. QA lecture cinéma, post couleur retenue, grain fin, son tôt, export documenté. La finition ne sauve pas un plan mort. Elle élève un plan déjà honnête.

Ce découpage n'est pas théorique : il devient ton arborescence dossier. 00_brief, 01_pilotes, 02_video_raw, 03_selection_ABC, 04_post, 05_masters. Quand un client demande « comment tu as obtenu ce regard stable », tu ouvres un dossier, pas une conversation floue.

Pour verrouiller la couche image avant même de penser moteur vidéo, garde sous la main comment transformer une image IA en vidéo fluide et crédible. C'est la fondation de tout pipeline complet image vers vidéo IA qui ne se fracasse pas à la deuxième seconde.

Phase 1 : brief plateau qui évite les catastrophes silencieuses

Tu n'écris pas un roman créatif pour impressionner un lecteur. Tu écris ce qu'un premier assistant réalisateur pourrait coller sur une porte sans perdre une information critique.

Commence par le sujet. Âge apparent, costume verrouillé, un accessoire identifiable si tu en veux un. Si tu laisses « jeune femme, streetwear », le modèle improvisera des logos qui mutent en vidéo. Si tu verrouilles trench beige, boutons mates, écharpe grise, tu réduis les glissements de palette.

Le lieu doit préciser intérieur ou extérieur, jour ou nuit, et ce qui domine dans le décor : briques, vitrine, bureau bois. Les textures dominantes influencent les artefacts : les motifs répétitifs aiment onduler si tu pousses un travelling long.

Lumière et heure : key latérale fenêtre, néon froid en contre, lampe tungstène à trois quarts arrière. Une source dominante évite la sensation flotte « HDR IA » qui saute d'une frame à l'autre.

Action unique : lecture de lettre avec micro mouvement de tête, pas lecture plus marche plus coup de vent plus dialogue. Une action. Un beat.

Interdits explicites : pas d'orbite au début si tu veux la géométrie stable ; pas de mains en premier plan sur la première passe si tu testes un nouveau modèle ; pas de texte lisible sur textile si tu veux éviter les mutations.

Un brief correct réduit les allers-retours émotionnels. Tu passes moins de temps à « réparer une idée » et plus de temps à améliorer un mouvement déjà acceptable.

💡 Frank's Cut: ajoute une ligne « caméra : quasi statique » même quand tu veux du dynamisme. Tu gagneras du dynamisme au montage avec coupe et son. Laisse la première génération respirer comme un plan tenu, pas comme un clip musical qui montre ses scratches.

Phase 2 : construire une pilote qui survit au temps

La pilote est le contrat visuel. Si elle est trop « Instagram smooth », la vidéo devient plastique. Si elle est trop chargée en détails contradictoires, le modèle oscillera entre priorités.

Checklist pilote avant passage vidéo :

- Triangle du visage lisible, texture peau présente sans porcelaine.

- Une source lumineuse dominante, une fill discrète, pas cinq sources contradictoires.

- Profondeur de champ cohérente : sujet net, fond un peu plus doux, évite l'inverse « décor chirurgical » sur sujet flou si tu ne assumes pas l'effet.

- Pas de petits textes lisibles sur vêtements ou accessoires : ils cassent au mouvement.

- Mains : hors champ ou geste simple si tu débutes sur ce pipeline.

Nomme tes fichiers comme un chef opérateur : PILOTE_scene03_v02.png. Mets le prompt complet dans notes.txt, avec seed si ton outil le permet. Dans six mois, tu ne devras pas deviner pourquoi la version quatorze était meilleure.

Pour la philosophie « cinéma » sur une pilote avant même la partie animation, croise avec workflow complet Seedance 2 pour un rendu cinéma. Même si tu changes de moteur demain, la discipline de pilote reste la même.

Si tu travailles avec plusieurs personnages, verrouille un bloc IDENTITÉ copiable tel quel entre plans. Change uniquement le bloc SCÈNE. Le pipeline multi-plans dérape quand tu modifies trois lignes simultanément entre deux exports et que tu perds la trace de ce qui a cassé la continuité.

Phase 3 : traduire le still en instruction temporelle (sans surenchère)

Le passage image vers vidéo est une traduction, pas une explosion de créativité. Tu passes d'une géométrie fixe à une déformation contrôlée sur quelques secondes.

Écris ta consigne mouvement comme un chef opérateur sur un steadycam léger : lent, motivé, sans gymnastique. Push-in très lent, sensation lock-off avec micro dérive, léger panoramique latéral si le décor est simple.

Évite les listes d'adjectifs « cinematic epic luxury 8K masterpiece ». Chaque mot ouvre une porte à interprétation contradictoire. Privilégie des termes physiques : lent, stable, respiration du sujet, grain film léger, aucune orbite.

Durée de départ recommandée : trois à cinq secondes. La dérive augmente avec le temps. Si tu dois raconter plus long, envisage deux clips avec coupes franches plutôt qu'une prise unique de douze secondes qui invente des mains.

Pour les moteurs où tu contrôles amplitude ou force du mouvement, commence bas. Monte par paliers. Change une variable à la fois entre deux batches : amplitude caméra ou geste sujet, pas les deux ensemble sinon tu ne sauras pas qui ment.

La cohérence narrative guide aussi le mouvement : un push-in lent colle à l'intimité ; un travelling latéral colle au passage dans un espace. Si tu mixes les deux sur une même phrase prompt sans hiérarchie, le modèle tranchera au feeling et tu n'aimeras pas le résultat.

Pour pousser la fluidité et le réalisme du mouvement avec une méthode comparable entre outils, ajoute comment améliorer le réalisme des mouvements en vidéo IA à ton dossier de lecture. Ce n'est pas du réglage vanity : c'est du vocabulaire partagé entre membres d'équipe.

Tableau : levier du pipeline et effet sur la stabilité

| Levier | Réglage de départ prudent | Ce qui casse si tu pousses trop tôt |

|---|---|---|

| Durée clip | 3 à 5 s | dérive visage, mains, textures |

| Amplitude caméra | faible / push-in lent | warping murs, verticales ondulantes |

| Action sujet | une micro vie | bouche et mâchoire qui glissent |

| Complexité décor | zones verticales simples | motifs qui respirent |

| Résolution itération | modeste | temps machine sans apprentissage |

| Upscale final | après validation mouvement | artefacts grossis, faux détails |

Ce tableau n'est pas une loi universelle : certains modèles tolèrent plus que d'autres. Mais si tu débutes sur un pipeline complet image vers vidéo IA, ces priorités te gardent dans une zone où tu apprends vite sans te battre contre des variables multiples.

Phase 4 : protocole batch et classement A/B/C

Tu ne juges pas une IA au premier rendu. Tu construis une petite étude statistique artisanale : quatre variations comparables, même pilote, même durée, même amplitude sauf si tu testes expressément un levier unique.

Référence de base : quatre passes, mouvement modeste. Classe chaque sortie A utilisable telle quelle, B récupérable au post avec dette assumée, C morte. Si tout est C, tu ne « prompts » pas plus fort en ajoutant du chaos : tu changes une décision de plateau (cadrage, durée, amplitude, pilote).

Note pour chaque clip : seed si disponible, amplitude, verdict, cause du refus si C. Cette discipline transforme ton dossier en mémoire collective. Les équipes junior deviennent senior plus vite quand elles lisent pourquoi une orbite a été bannie sur une façade vitrée.

Définis une règle de pivot : par exemple quarante-cinq minutes ou douze variations maximum par plan avant de changer un paramètre majeur. Sinon tu entres dans la spirale « encore un essai » qui épuise le projet sans livrer.

Si tu compares des outils sur la même pilote, garde strictement identiques durée et intention mouvement. Sinon tu confonds les pommes et les oranges. Pour une exploration structurée du côté animation réaliste avec un autre moteur, tu peux t'appuyer sur workflow Kling 3 pour une animation fluide et réaliste comme contrepoint méthodologique : le pipeline change peu, seuls les réglages UI bougent.

Phase 5 : QA lecture cinéma en vingt secondes

Tu lis un clip en vingt secondes, sans cheat sheet ouverte. Dans l'ordre :

- Yeux : symétrie, clignements étranges, reflets qui sautent sans motivation.

- Mâchoire : dérive latérale ou fusion avec le cou.

- Mains : doigts, fusion, objets qui changent de contour.

- Cheveux au pourtour du visage : filaments qui deviennent verre ou fumée.

- Verticales du décor : portes, fenêtres, cadres.

Si deux zones critiques lâchent, tu n'as pas un « on verra » : tu as une dette. Le montage masque une coupe. Il ne recolle pas une géométrie qui glisse.

Refais une passe sans son puis avec un room tone bas. Le son influence ta lecture de texture. Beaucoup de clips jugés « nets » sans son révèlent une surface plastique dès qu'un environnement acoustique minimal existe.

💡 Frank's Cut: filme ton écran avec ton téléphone une fois. Pas pour le pixel peek : pour voir comment la compression et la petite taille révèlent une surexposition ou un sharpen invisible sur desktop. Beaucoup de pipelines cassent à la livraison mobile, pas à la génération.

Phase 6 : post et finition sans maquillage mensonger

Le post sauve le presque bon. Il ne ressuscite pas un plan catastrophique.

Correction primaire : une température cohérente entre les plans d'une même scène. Contraste léger : évite la courbe en S agressive sur visages IA qui transforme les pores en graphisme.

Grain fin, surtout dans les ombres : il aide à unifier des textures trop propres. Netteté : presque aucune au début. Un sharpen agressif amplifie les artefacts temporels après compression.

Si tu livres plusieurs formats, prévois le recadrage dès la pilote pour du vertical. Recadrer brutalement un 16:9 où le visage est au bord du cadre déclenche souvent des surprises au mouvement.

Pour la culture générale utile sur la chaîne image et la cohérence lumière cadre mouvement, la page cinématographie reste une référence sobre sur ce qui relie intention et technique. Ce n'est pas un tutoriel bouton : c'est un rappel que le cinéma reste une discipline de hiérarchie visuelle.

Les documents ARRI sur les systèmes caméra expliquent bien une idée transposable à l'IA : chaîne optique et colorimétrique plutôt que miracle LUT unique. Ton pipeline complet doit penser comme une chaîne, pas comme un filtre magique posé à la fin.

Phase 7 : son, montage, livraison : la partie invisible qui fait croire

Une vidéo IA « silencieuse » trompe souvent ton jugement. Ajoute tôt un ambiancé minimal, même placeholder : rue lointaine, climatisation, pluie contre fenêtre. Tu calibreras mieux la présence physique du plan.

Au montage, privilégie les coupes franches entre deux géométries différentes plutôt que des transitions qui forcent le modèle à inventer un passage impossible. Si tu enchaînes deux clips issus de pilotes différentes, vérifie la continuité costume et lumière comme un raccord de tournage classique.

À l'export, documente cadence 24 fps ou 25 fps selon destination, codec, bitrate cible. La compression H.264 sur plateformes grand public rognera encore du grain fin : prévois un peu de texture en amont pour ne pas retomber dans la cire après upload.

Trois scénarios terrain pour tester ton pipeline de bout en bout

Scénario A : pub produit quinze secondes

Brief : main féminine, produit premium, table bois, fenêtre fin d'après-midi. Pilote en gros plan avec une tache nette sur le produit, fond doux. Mouvement : push-in lent trois secondes, mains geste minimal pose objet.

Batch quatre variations, classe A/B/C. Post : contraste léger, grain fin. Son : micro friction main bois, tic discret si la charte sonore le permet. Livraison : master horizontal plus déclinaison 9:16 prévu dès la pilote.

Scénario B : fiction intérieur, moment intime

Brief : plan poitrine, dialogue court mais lip-sync limité au début pour réduire risque. Pilote verrouillée sur costume et key fenêtre. Vidéo : quatre secondes, tête qui baisse puis relève, une seule action.

Montage : coupe sur le regard. Son : voix enregistrée séparément si possible pour éviter la bouche qui invente des phonèmes. QA stricte sur mâchoire.

Scénario C : corporate sobre

Brief : portrait cadre entreprise, fond propre mais pas vide cartoon. Mouvement modeste, sensation interview stable. Attention aux motifs derrière la tête : tableaux, logos muraux. Post sobre, sharpening quasi nul. Livraison avec preview compressée pour validation mobile des parties prenantes.

Troubleshooting : ce que les débutants cassent (fixes précis)

Visage qui respire. Cause fréquente : pilote trop lisse ou amplitude caméra trop forte. Fix : textures peau plus présentes sur pilote, amplitude réduite, durée ramenée à trois secondes.

Couleur de vêtement qui migre. Cause : deux couleurs contradictoires dans prompts ou ombre instable. Fix : une couleur déclarée dans identité, lumière stable, éviter relighting violent dans post sur premières passes.

Murs qui ondulent. Cause : travelling sur façade répétitive ou lignes fines fortes. Fix : caméra quasi statique ou décor simplifié sur la pilote.

Mains fusionnées. Cause : geste complexe plus gros plan. Fix : plan plus large pour les premières passes, mains hors champ si possible.

Image ultra nette mais sensation fake. Cause : HDR IA sans motivation lumineuse. Fix : hiérarchie de sources, micro imperfections naturelles sur textures.

Comparaison d'essais impossible. Cause : durées et mouvements différents entre variations. Fix : normalise protocole avant jugement.

Tu escalades en 4K trop tôt. Cause : espoir que la résolution masque. Fix : valide mouvement en modeste, upscale après gate validation.

Client trouve ça « trop IA » après compression. Cause : validation uniquement sur écran calibré large. Fix : preview téléphone et bitrate réaliste tôt.

[🎥 WATCH: Check out this breakdown on the Business Dynamite YouTube channel: https://www.youtube.com/@BusinessDynamite - Specifically look at the segment on structurer un pipeline complet image vers vidéo et éviter les erreurs classiques de mouvement caméra sur une pilote fixe.]

FAQ

Foire aux questions

Réponses rapides aux questions les plus fréquentes sur cet article.

Qu'est-ce qu'un pipeline complet image vers vidéo IA concrètement dans un dossier projet ?

Un pipeline complet image vers vidéo IA, ce n'est pas une opinion créative : c'est une arborescence et une série de sorties nommées que n'importe qui peut rouvrir sans te téléphoner à deux heures du matin. Tu dois retrouver le brief en cinq lignes, la pilote PNG finale utilisée, les prompts archivés, les exports vidéo numérotés avec classement A/B/C, les notes de seeds ou réglages, puis les masters post et les previews compressées. Quand une équipe reprend le dossier trois semaines plus tard, elle peut rejouer une décision sans deviner ce qui a été testé. Ajoute une ligne par essai raté avec la cause probable : ça évite de répéter la même erreur parce que « la semaine dernière ça avait l'air différent ». C'est exactement ce qui sépare un hobby d'une capacité de livraison répétable pour cliente ou diffuseur.

Pourquoi mon image est belle mais ma vidéo « casse » après deux secondes ?

Les modèles vidéo résolvent un problème plus dur que la frame fixe : ils doivent extrapoler de la géométrie dans le temps sans autorité physique réelle, sans pellicule, sans capteur, sans lentille qui impose une continuité humble. Une pilote peut être esthétique tout en étant géométriquement ambiguë pour les contours fins, les mains presque correctes, ou les textures contradictoires entre premier plan et arrière-plan. Le mouvement révèle ces tensions en les animant comme une loupe impolie sur tes raccourcis de prompting. Ce que tu vois « après deux secondes », ce n'est souvent pas une surprise mystique : c'est une incohérence qui dormait dans la frame. Réduis les contradictions sur la pilote, diminue l'amplitude caméra, raccourcis la durée, puis reteste avec un protocole batch discipliné avant de conclure que « l'outil ne marche pas ».

Combien de secondes dois viser au début pour stabiliser un portrait ?

Pour la majorité des pipelines portrait sérieux, trois à cinq secondes est une plage réaliste avant que la dérive ne grimpe trop vite sur les zones critiques comme yeux, bouche et cheveux au contour. Ce n'est pas une limite morale du métier : c'est une observation terrain sur la façon dont les visages et les micro textures réagissent à l'extrapolation temporelle quand tu pousses le geste et la caméra ensemble. Si tu veux raconter plus long, cumule des segments avec montage et son plutôt qu'une prise unique qui demande au modèle de mentir pendant douze secondes sur plusieurs axes simultanément. Pense « deux beats courts » au lieu d'une séquence unique qui accumule les risques.

Dois-je toujours utiliser le même modèle vidéo pour tout mon projet ?

Pas nécessairement, mais tu dois documenter les écarts de rendu comme tu documentes deux stocks différents en tournage classique. Des moteurs différents ont des signatures de mouvement, des tolérances mains différentes, des comportements distincts sur paysage versus portrait, et parfois des habitudes de couleur qui bougent au bout de quelques secondes. Si tu mixes au sein d'une même scène, harmonise en post avec une intention unique et préviens le client des limites avant la présentation. Pour une recherche d'animation réaliste avec une méthode comparable, certaines équipes croisent plusieurs workflows ; l'important reste que ton protocole de test soit identique entre essais comparables, sinon tu juges des résultats qui ne viennent pas du même protocole.

Le post-production peut-il sauver une vidéo IA ratée ?

Le post peut masquer une exposition approximative, un léger flicker, une saturation trop agressive, ou une ambiance plate qui vend mal après compression. Il peut aussi aider à rapprocher deux clips qui étaient presque dans la même température de couleur. Mais il ne répare pas une mâchoire qui glisse, une main fusionnée sur une action critique, ou une géométrie qui invente des lignes au fil du temps. Traite le post comme une couche d'intention et d'unification, pas comme une ambulance pour une géométrie cassée : sinon tu passes des heures sur un plan qui restera menteur au montage final et qui explosera sur téléphone.

Comment convaincre un client que la chaîne IA est sous contrôle ?

Tu livres de la transparence utile : bible visuelle courte, liste des dettes assumées, exemple de protocole A/B/C, et fichiers organisés où chaque plan a une adresse claire. Tu montres une preview compressée tôt pour éviter la surprise mobile, parce que beaucoup de désaccords viennent d'une différence d'écran plutôt que d'une différence artistique. Tu relies les choix à des intentions plateau compréhensibles par quelqu'un hors technique : « caméra stable », « lumière fenêtre », « action minimale », ce sont des phrases qui rassurent plus que trois pages de vocabulaire modèle. La confiance ne vient pas du jargon « modèle multimodal », elle vient de méthode visible et de résultats reproductibles.

Est-ce que le pipeline complet remplace un tournage traditionnel ?

Pour une partie des usages, oui : maquettes, plans impossibles sans budget, itérations rapides avec limites assumées, tests de rythme avant une vraie journée plateau. Pour des scènes complexes avec jeu d'acteur long et interactions précises sur plusieurs corps et objets, souvent non sans compromis lourds qui finissent au prix du temps humain quoi qu'il arrive. Le bon cadre n'est pas « tout remplacer », mais « où cette chaîne est la meilleure option sous contrainte budget, délai, ou exploration ». Le pipeline complet image vers vidéo IA te permet de répondre avec lucidité plutôt qu'avec marketing vague, et d'écrire noir sur blanc ce qui est dedans et ce qui est hors périmètre.

Comment éviter de passer une nuit sur quarante variations inutiles ?

Tu installes une règle de pivot et une limite d'essais comparables, puis tu la respectes même quand l'égo crie qu'il manque « juste un dernier essai ». Tu changes une variable à la fois quand tout est classé C, sinon tu ne sauras pas ce qui a bougé entre deux rendus. Tu refuses de compenser par des prompts plus longs si la pilote ment : la verbosité masque rarement une géométrie instable. Tu passes à un autre angle, une autre durée, ou une autre intention caméra plutôt que de marteler le même réglage en espérant la magie. La fatigue crée des mauvaises décisions et fait accepter des artefacts ; la méthode protège ton jugement et ton planning.

Tu n'as pas besoin d'une chaîne d'outils plus chère pour commencer : tu as besoin d'un pipeline complet image vers vidéo IA qui nomme les étapes, archive les décisions, et refuse les plans qui mentent. La discipline fait plus pour ton rendu cinéma que dix adjectifs dans un prompt.

Session type deux heures pour un plan critique

: vingt minutes brief plus pilote, quarante-cinq minutes batch vidéo, vingt minutes QA, vingt-cinq minutes post léger, dix minutes exports plus note client. Si tu dépasses sans classe A, change un levier majeur plutôt que ta dose de café.

Checklist livraison minimale

: master avec cadence documentée, LUT ou correction décrite en deux lignes, liste des plans avec dettes assumées, preview compressée validée sur téléphone, mention des briques IA si ton contrat l'exige.

Continuer la lecture

Comment créer un storyboard avec l'IA étape par étape

Pour créer un storyboard IA étape par étape sans rendu plastique ni galerie décorative : découpage script, bible visuelle, prompts stables, QA séquentielle et livrable production.

Comment optimiser son workflow IA pour gagner du temps

Méthode concrète pour optimiser workflow IA et gagner du temps : diagnostic des fuites, timeboxing, organisation des assets, QA et itérations sans dispersion.

Comment organiser ses assets IA comme un pro

Méthode complète pour organiser assets IA, dossiers, nommage, métadonnées, versions et livraison sans perdre le fil entre image, vidéo, voix et montage.