Upscaling vidéo : passer son vieux court-métrage en 4K avec l’IA

Méthode de terrain pour upscaler un vieux court-métrage en 4K avec l’IA, préserver la texture cinéma et éviter les artefacts qui trahissent un rendu amateur.

Upscaling vidéo 4K IA: comment restaurer un vieux court-métrage sans le défigurer

Tu as tourné un court-métrage il y a trois ans. Tu lances ton master sur un écran moderne. Et là ça pique. Les visages bavent, les contours scintillent, les aplats de nuit s’effondrent en macroblocs, et ton plan préféré ressemble à une vidéo compressée sortie d’un vieux téléphone. Tu te dis que l’IA va tout réparer en un clic. C’est précisément là que beaucoup ruinent leur film.

Je vais être direct. L’upscaling vidéo 4K avec l’IA ne pardonne pas les raccourcis. Si tu balances un mauvais fichier source dans un preset trop agressif, tu ne restaures rien. Tu fabriques une version HD de tes défauts. J’ai fait cette erreur sur une séquence nocturne tournée en caméra légère, et j’ai perdu deux jours à corriger des halos que j’avais moi-même créés.

La bonne nouvelle, c’est qu’il existe une méthode claire. Tu vas apprendre à faire un audit technique propre, à choisir un workflow robuste, à régler les paramètres qui comptent vraiment, puis à valider ton résultat comme un pro qui prépare une diffusion réelle. L’objectif est simple: obtenir un rendu crédible, texturé, cinématographique, sans cet effet plastique qui crie "traitement IA".

Core concepts: ce que l’upscaling vidéo IA change vraiment dans l’image

L’upscaling vidéo avec IA n’est pas une loupe magique. C’est une opération de reconstruction probabiliste. Le modèle observe les patterns de ton image, puis prédit des détails plausibles pour combler ce qui manque à la résolution d’origine. Le mot clé ici est plausible. Pas authentique. Si tu ne contrôles pas ton process, il invente des textures séduisantes mais incohérentes d’un plan à l’autre.

Pour un débutant, le piège est de confondre netteté perçue et qualité narrative. Une image peut sembler "plus sharp" et pourtant tuer l’émotion, parce que la peau devient cireuse, le grain disparaît, ou les micro-variations de lumière qui rendaient la scène vivante sont remplacées par un bruit artificiel uniforme. En pub et en fiction courte, ce détail fait la différence entre un rendu premium et un rendu "démo technique".

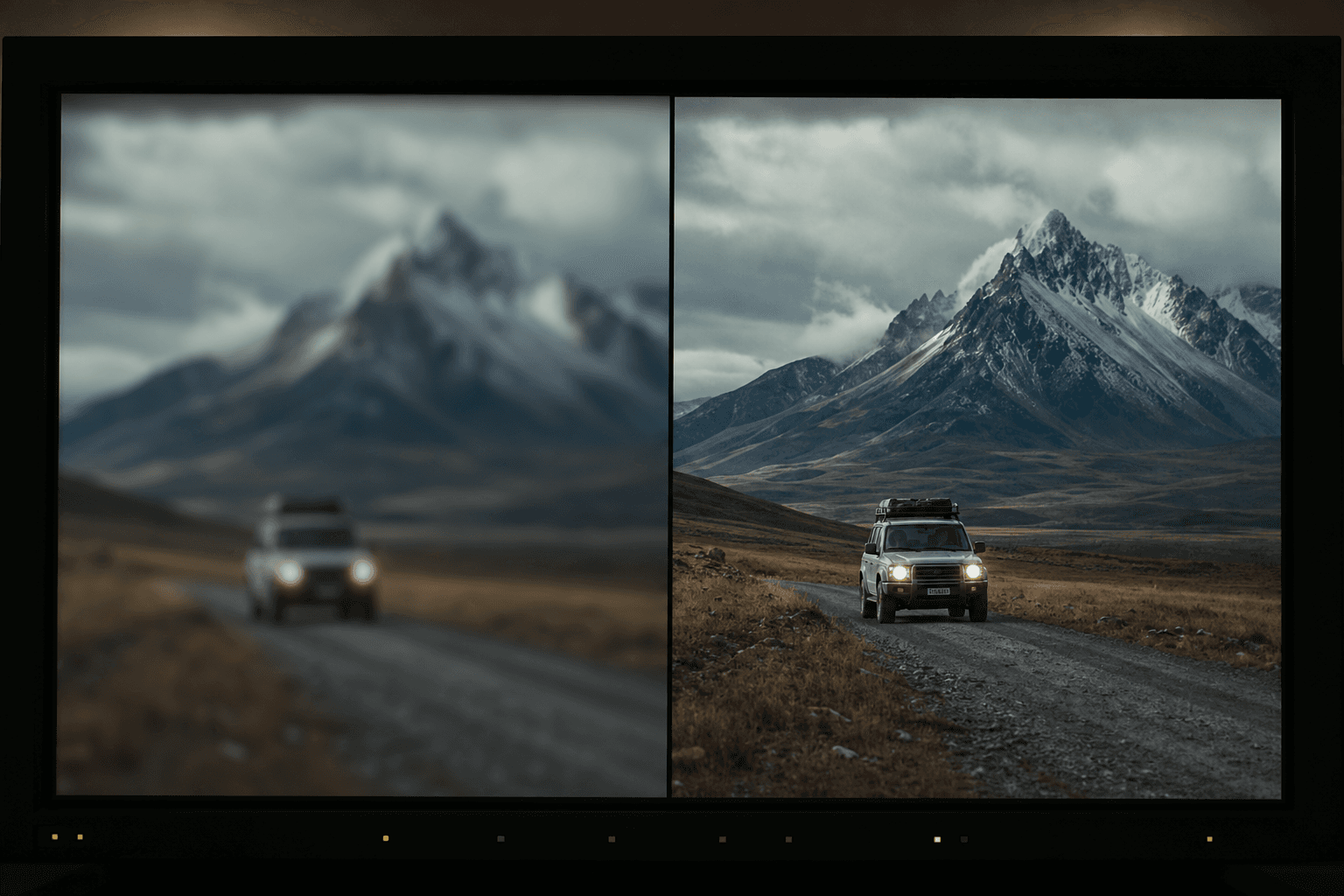

Tu dois aussi comprendre la notion de cohérence temporelle. L’upscaling s’évalue en mouvement, pas en pause. Un frame fixe peut paraître parfait, puis révéler du scintillement autour des yeux, des contours qui respirent, ou des textures de mur qui "pompent" d’une image à la suivante. C’est exactement ce qui détruit la crédibilité d’un plan ciné, même quand la miniature est superbe.

Sur mes projets, je traite l’upscaling comme une étape de finishing, pas comme une rustine de sauvetage. Ça veut dire pipeline strict: source propre, réglages contextuels, passes de contrôle, et validation multi-écrans. Si tu appliques cette discipline, tu peux transformer des rushes anciens en matériel exploitable pour YouTube 4K, pitch client, et même projection de travail.

Le plus important reste ton intention de mise en scène. Si tu ne sais pas ce que doit ressentir le spectateur, tu vas surtraiter les détails secondaires. Pour solidifier ce socle artistique avant l’étape technique, relis notre guide complet pour passer d’une idée à un film IA réaliste. C’est la base pour éviter de livrer une image propre mais vide.

| Cas réel | Source typique | Objectif 4K IA | Réglage prioritaire | Risque principal | Correction efficace |

|---|---|---|---|---|---|

| Court-métrage festival ancien | 1080p H.264 8-bit | Diffusion UHD propre | Denoise modéré + Recover Detail faible | Peau plastique | Réinjecter grain fin en post |

| Clip très compressé web | 720p fortement artefacté | Version social premium | Pré-nettoyage macroblocs + upscale progressif x1.5 puis x1.33 | Sur-accentuation des contours | Baisser Sharpen et lisser localement |

| Fiction low light | 1080p bruité ISO élevé | Conserver ambiance nocturne | Préserver basses lumières + upscale doux | Noir bouché ou "huileux" | Courbe luma + texture séparée ombres |

| Interview archive | 1080p variable | Uniformiser série d’épisodes | Profil unique de base puis exceptions plan à plan | Flicker des détails fins | Contrôle temporel + masques ciblés |

The trench workflow: méthode terrain pas à pas pour un upscale 4K crédible

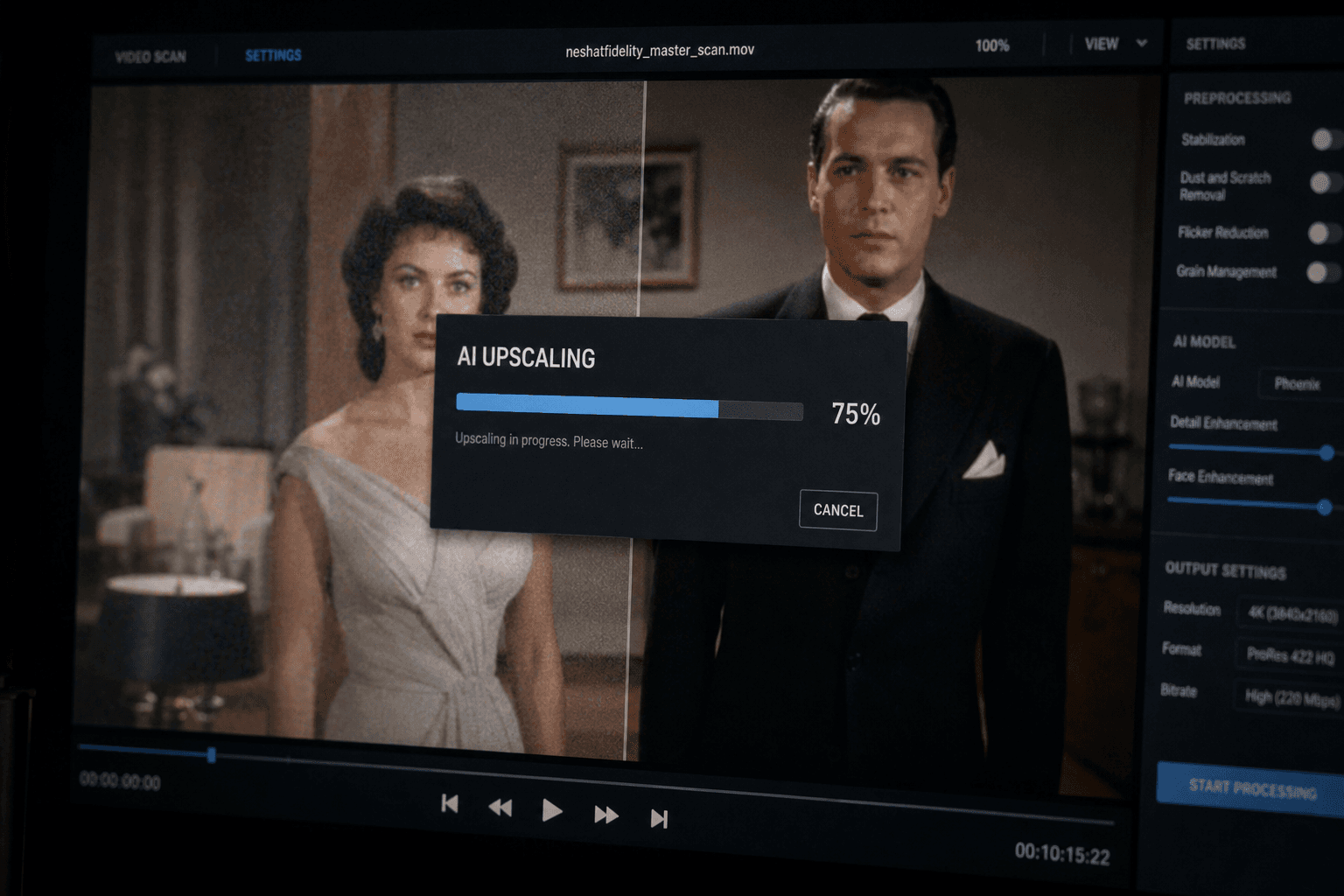

Voici la routine que j’utilise quand je reprends des plans trop faibles pour une diffusion moderne. Elle est faite pour les débutants sérieux qui veulent apprendre vite, sans s’enfermer dans un laboratoire de presets. Tu peux l’exécuter sur Topaz Video AI, DaVinci Resolve, ou un pipeline mixte. Ce qui compte, c’est l’ordre des décisions.

Le premier réflexe est de verrouiller ton résultat cible avant de toucher au moindre curseur. Tu dois définir plateforme, durée, codec de sortie, tolérance au bruit, et style visuel final. Une pub digitale ultra propre et un court de fiction texturé ne demandent pas les mêmes compromis. Si tu ignores cette étape, tu passes ton temps à "améliorer" une image vers un objectif flou.

Ensuite, travaille en itérations courtes avec versioning strict. Je recommande une convention de nommage simple: film_plan012_v03_upscale-soft_4k. Oui, c’est un détail. Non, ce n’est pas du fétichisme technique. En production réelle, cette discipline te sauve quand un client demande "la version un peu moins nette mais plus organique" à 23h.

Chaque itération doit être comparée dans la timeline complète, pas en lecture isolée. Tu regardes l’entrée du plan, le plan lui-même, puis sa sortie. Beaucoup d’artefacts ne se voient qu’aux transitions. C’est là que les débutants se font piéger et pensent que leur rendu est propre alors qu’il saute immédiatement au montage.

Enfin, garde un journal de réglages. Tu notes ce qui casse l’image, ce qui l’améliore, et dans quel contexte. Au bout de cinq sessions, tu auras ton propre playbook. C’est ce qui fait passer un créateur d’essais aléatoires à un workflow professionnel répétable.

Scénario 1: restaurer un court-métrage 1080p trop compressé sans effet plastique

Imagine un court tourné en 2019, master final en H.264 1080p avec débit faible. La première erreur serait de lancer direct un upscale x2 avec un preset "high detail". Tu vas amplifier les blocs de compression et créer des contours sales autour des visages. Ici, la priorité n’est pas la netteté. La priorité est la propreté structurelle.

Commence par un pré-traitement léger. Tu réduis le bruit de compression sans lisser les traits. Sur Topaz, je reste volontairement conservateur: Denoise bas, Recover Original Detail bas à moyen, puis une netteté finale douce. Sur Resolve, tu peux préparer avec réduction de bruit temporelle modérée avant upscale, puis contrôler les hautes fréquences en sortie.

Quand la matière est propre, upscale en deux étapes si besoin. Une passe douce vers 1440p, puis une seconde vers 2160p. Ça réduit parfois les hallucinations de texture qu’on voit sur les montées brutales. C’est plus lent, oui. Mais en contrôle qualité, tu gagnes du temps parce que tu corriges moins de dégâts.

Teste ensuite sur trois plans critiques: visage en mouvement, texture de décor, et basses lumières. Si l’un des trois casse, tu ajustes le modèle avant de batcher tout le film. Cette étape paraît basique, mais c’est le vrai passage pro. Batcher trop tôt, c’est la recette garantie pour refaire une nuit entière de rendu.

💡 Frank's Cut: quand tu hésites entre deux versions, prends celle qui semble légèrement moins "impressionnante" en pause mais plus stable en lecture. Le spectateur juge la fluidité et la cohérence, pas la surenchère de détails.

Scénario 2: sauver une scène nocturne bruitée sans tuer l’ambiance cinéma

Les scènes de nuit sont le cimetière des presets agressifs. Tu veux nettoyer le bruit, puis tu te retrouves avec un noir compact, sans respiration, et une peau qui ressemble à du silicone. Si tu vises un rendu cinématographique, tu dois conserver une part de texture dans les basses lumières. Le "propre absolu" ruine l’atmosphère.

Je te conseille de traiter la luma et la chroma séparément quand c’est possible. En pratique, on retire plus de bruit coloré que de bruit de luminance. Pourquoi ? Parce que le bruit luma peut participer à une sensation organique, alors que le bruit chroma sale immédiatement l’image. Beaucoup de débutants font l’inverse, et c’est là que le rendu devient artificiel.

Sur les plans de nuit, verrouille aussi ton contraste avant l’upscale final. Si tu laisses une courbe trop dure, l’IA invente des transitions brutales et des halos dans les zones sombres. Je préfère une base plus douce, puis une remontée précise du contraste en post. C’est plus contrôlable et plus fidèle à l’intention originale du plan.

La dernière clé, c’est le grain. Oui, il faut souvent en remettre. Mais pas un grain "instagram". Un grain fin, homogène, cohérent avec le niveau de lumière. Pour ça, va revoir notre méthode pour ajouter un grain cinéma naturel sur image IA. Ce réglage seul peut faire passer ton rendu de fake à crédible.

Scénario 3: uniformiser un film composé de sources hétérogènes

Cas ultra courant chez les créateurs indépendants: un film monté avec plusieurs caméras, plusieurs périodes, et parfois des exports intermédiaires perdus. Tu as des plans propres, des plans mous, des plans trop contrastés, des plans bruités. Si tu appliques un preset unique à tout le projet, tu fabriques une catastrophe cohérente dans l’échec.

La bonne approche est de créer des familles de plans. Par exemple: "visages jour", "intérieurs sombres", "plans larges extérieurs", "archives compressées". Tu définis un profil de base par famille, puis des micro-ajustements plan par plan. Ça peut sembler plus long au départ, mais c’est le seul moyen d’obtenir une homogénéité qui tient en projection.

Pense aussi au cadrage pendant cette phase. Un upscale qui accentue des détails secondaires peut détourner le regard du sujet principal. C’est fréquent sur les plans larges. Pour corriger, recale légèrement ton contraste local et ta netteté autour de la zone d’attention. Le guide comment cadrer une image IA comme un pro du cinéma te donne le vocabulaire visuel exact pour ça.

À ce stade, valide chaque famille sur une séquence de 20 à 30 secondes, pas sur un seul shot. Si la continuité visuelle tient sur cette plage, alors tu peux lancer les rendus complets. C’est cette discipline qui transforme un montage disparate en film cohérent.

[🎥 WATCH: Check out this breakdown on the Business Dynamite YouTube channel: https://www.youtube.com/@BusinessDynamite - Specifically look at the segment on upscale pipeline for cinematic consistency]

Troubleshooting: ce que les débutants cassent et comment le réparer vite

Le bug numéro un, c’est la sur-accentuation des contours. Tu lances un preset fort, tout devient "net", et tu penses avoir gagné. En réalité, les visages se découpent artificiellement du fond, les cheveux scintillent, et les textures fines vibrent. La correction est simple: baisse la netteté globale, puis remonte localement uniquement sur les zones utiles au récit.

Deuxième casse fréquente, le flicker temporel. En frame fixe ça passe. En lecture, les détails "respirent". La cause est souvent un modèle poussé trop loin ou un pré-traitement incohérent entre plans. Fixe une chaîne stable, évite de changer de preset toutes les dix minutes, et valide toujours en mouvement réel. Si le flicker persiste, reviens à un niveau de détail plus conservateur.

Troisième erreur, la peau cireuse. Tu nettoies trop, tu perds les micro-variations, et les visages deviennent de la matière synthétique. Pour réparer, remonte un peu de texture, réduis le denoise, et contrôle ton contraste de proximité. Si nécessaire, applique un traitement différencié sur les visages via masques. Un réglage global ne suffit pas toujours.

Quatrième piège, les noirs bouchés après upscale. Ça arrive surtout sur les séquences nocturnes ou sous-exposées. Tu dois corriger la courbe de luminance avant ou juste après la reconstruction, puis vérifier sur écran à luminosité basse. Un plan "beau" dans une salle claire peut devenir illisible sur mobile. Le test mobile n’est pas une option. C’est une obligation.

Cinquième point critique, la cohérence de projet. Beaucoup de débutants optimisent plan par plan sans vision globale. Résultat, chaque plan est défendable seul, mais l’ensemble raconte une esthétique instable. Mets en place une revue toutes les 5 à 8 minutes de timeline, compare les séquences adjacentes, et note les écarts de texture, contraste, et colorimétrie avant d’exporter.

Dernier rappel: ce n’est pas parce qu’un outil annonce une IA "cinema quality" que ton rendu devient ciné automatiquement. Le rendu final dépend de ton intention et de ton pilotage. Si tu veux travailler la qualité visuelle dès la phase génération, pas seulement en restauration, lis notre guide pour écrire un prompt cinematic ultra réaliste. Tu économiseras énormément de corrections en aval.

💡 Frank's Cut: crée un preset "sécurité diffusion" un peu moins ambitieux, mais ultra stable. Quand la deadline tape fort, c’est ce preset qui te protège contre les surprises de dernière minute.

Références externes utiles et fiables

Quand tu veux vérifier la logique technique derrière un réglage, appuie-toi sur des sources solides au lieu de copier des threads contradictoires. Le manuel des filtres FFmpeg reste une base sérieuse pour comprendre les chaînes de traitement vidéo. La documentation officielle Topaz Video AI est utile pour lire les comportements modèles par modèles. Et pour la partie étalonnage / finishing, la doc DaVinci Resolve aide à cadrer un pipeline pro de postproduction.

"Ce qui sépare un rendu amateur d’un rendu pro, ce n’est pas l’outil choisi. C’est la capacité à reproduire un résultat propre sur plusieurs projets, sous contrainte de temps."

FAQ: questions que les débutants posent avant de lancer un upscale 4K IA

-

Faut-il forcément une machine très puissante pour faire de l’upscaling vidéo 4K IA ?

Tu peux démarrer sans station monstrueuse, mais il faut adapter ton workflow. Sur une machine modeste, travaille en extraits courts de 5 à 10 secondes pour valider tes réglages, puis lance des batchs segmentés plutôt qu’un export complet. Le vrai gain ne vient pas uniquement du GPU, il vient de ta méthode de test. J’ai vu des créateurs avec des machines haut de gamme perdre des heures, alors qu’un workflow simple et discipliné sur une config moyenne donnait un meilleur résultat final. Priorise la stabilité des réglages avant la vitesse brute. -

Quel est le meilleur outil entre Topaz, Resolve et FFmpeg pour débuter ?

Il n’existe pas de meilleur outil absolu, seulement le meilleur outil pour ton niveau et ton objectif. Topaz est souvent plus rapide à prendre en main pour obtenir un résultat visible, Resolve est excellent pour intégrer upscale, étalonnage et finishing dans une même chaîne, FFmpeg est redoutable pour industrialiser des traitements reproductibles. Si tu débutes, commence par un outil visuel, mais garde une logique de pipeline claire. Le piège est de changer d’outil à chaque vidéo. La cohérence de méthode compte plus que la marque du logiciel. -

Dois-je upscaler tout le film d’un coup ou plan par plan ?

Fais d’abord un diagnostic par familles de plans, puis traite avec des profils cohérents. Upscaler tout d’un coup peut fonctionner sur un projet très homogène, mais dans la vraie vie les sources sont souvent hétérogènes. En pratique, je recommande de tester trois plans critiques par famille, valider les réglages, puis lancer le batch correspondant. Cette approche limite les erreurs massives et garantit une meilleure continuité visuelle. Plan par plan uniquement si un shot clé casse malgré le profil familial. Sinon, tu vas te noyer dans des micro-ajustements interminables. -

Comment éviter l’effet "jeu vidéo" après upscaling ?

L’effet "jeu vidéo" vient souvent d’une combinaison de sharpening excessif, contraste trop dur, et textures trop propres. Pour l’éviter, garde de la matière dans les basses lumières, limite l’accentuation globale, et réintroduis un grain fin cohérent avec la scène. Pense aussi à la colorimétrie: des teintes peau trop saturées et des noirs trop denses basculent vite vers un rendu artificiel. Le test décisif reste la lecture en mouvement. Si le plan attire l’attention sur son traitement au lieu de servir l’histoire, c’est que tu as poussé trop loin. -

Pourquoi mon rendu est propre sur mon écran mais mauvais sur mobile ?

Parce que ton workflow de validation est incomplet. Un écran de travail calibré masque parfois des problèmes qui explosent sur un smartphone, notamment dans les zones sombres, les contours fins et la compression finale de plateforme. Tu dois tester systématiquement sur au moins trois contextes: écran principal, laptop standard, mobile. Vérifie aussi le codec et le débit de sortie, car un excellent master peut être détruit par un mauvais export. La règle simple: si le rendu reste lisible et naturel sur mobile, il passera beaucoup mieux partout. -

Faut-il conserver du bruit ou tout nettoyer avant l’upscale ?

Tout nettoyer est rarement une bonne idée. Une part de texture participe à la perception naturelle de l’image, surtout en fiction. Le but est d’enlever le bruit gênant, pas de stériliser l’image. Retire d’abord les défauts qui perturbent la lecture narrative, comme les artefacts colorés ou les blocs de compression, puis conserve une base organique. Ensuite, si nécessaire, ajoute un grain contrôlé en finition pour harmoniser l’ensemble. Cette logique te permet d’éviter la peau plastique et les aplats morts, tout en gardant une sensation de matière crédible. -

Combien de temps prévoir pour restaurer un court-métrage de 10 minutes en 4K IA ?

Pour un premier projet sérieux, compte entre une demi-journée et deux jours selon l’état des sources, la puissance de ta machine, et ton niveau d’exigence. Le temps se joue surtout dans les validations, pas uniquement dans le rendu. Prévoyez un bloc pour audit, un bloc pour tests de réglages, un bloc pour batch, puis un bloc de contrôle qualité. Si tu essaies d’aller trop vite, tu vas refaire des exports complets. Le meilleur accélérateur n’est pas la précipitation, c’est un protocole clair exécuté sans improvisation. -

Comment savoir si mon upscale est vraiment prêt à publier ?

Pose-toi trois questions simples. Est-ce stable en mouvement, y compris sur transitions ? Est-ce cohérent entre plans adjacents ? Est-ce lisible sur mobile sans artefacts évidents ? Si la réponse est oui aux trois, tu as déjà un niveau publication solide. Ensuite, fais une pause de quelques heures et revois la vidéo à froid. Ce recul révèle des défauts que ton œil habitué ne voit plus. En production pro, cette dernière relecture évite beaucoup de livrables "presque bons" qui coûtent ensuite des retours client.

Continuer la lecture

Comment améliorer un rendu moyen en rendu pro

Un plan vidéo IA correct ne suffit pas sur un écran sérieux : diagnostic par couches, chaîne de post solide, upscaling maîtrisé et discipline de rejet pour passer d'un rendu moyen à un rendu pro sans magie ni promesses trompeuses.

Comment transformer une vidéo IA en publicité premium

Méthode complète pour transformer une vidéo IA en publicité premium : cadre créatif orienté conversion, cohérence visuelle disciplinée, post-production sérieuse et contrôle qualité média comme une agence. Le mot-clé transformer vidéo IA publicité premium devient ici une check-list exécutable.

Comment mixer audio et image pour un rendu cinéma

Mixer audio et image pour un rendu cinéma sur vidéo IA : hiérarchie sonore, stems, dynamique, spatialisation, calibration avec l’étalonnage et livraison sans fatigue ni sensation « démo ».