Étalonnage IA : maîtriser le look et la couleur de ses films

Pipeline complet pour corriger, harmoniser et styliser une image avec l'IA sans casser les peaux ni la continuité : scopes, groupes de plans, masques intelligents et exports fiables.

Étalonnage IA : maîtriser le look et la couleur de ses films sans être coloriste

Tu viens de verrouiller ton montage. Les rythmes tiennent. Les sons respirent. Puis tu ouvres la page couleur et tu te sens minuscule. Tu balances une LUT au hasard, tu tires un peu le contraste, et d'un coup ton film ressemble à une pub pour téléphones. Ce n'est pas un problème de goût. C'est un problème d'ordre de travail. L'étalonnage IA peut te sauver des heures, mais seulement si tu traites la couleur comme une chaîne : normalisation, correction, continuité, puis style.

La bonne nouvelle, c'est que tu n'as pas besoin d'être coloriste hollywoodien pour obtenir un rendu crédible. Tu dois être rigide sur la méthode et humble sur les presets. Ce guide te donne les concepts qui changent vraiment l'image, un workflow de tranchée, trois scénarios réels, une section dépannage, et une foire orientée débutants qui veulent livrer proprement.

Core concepts : ce qui change vraiment la qualité d'image

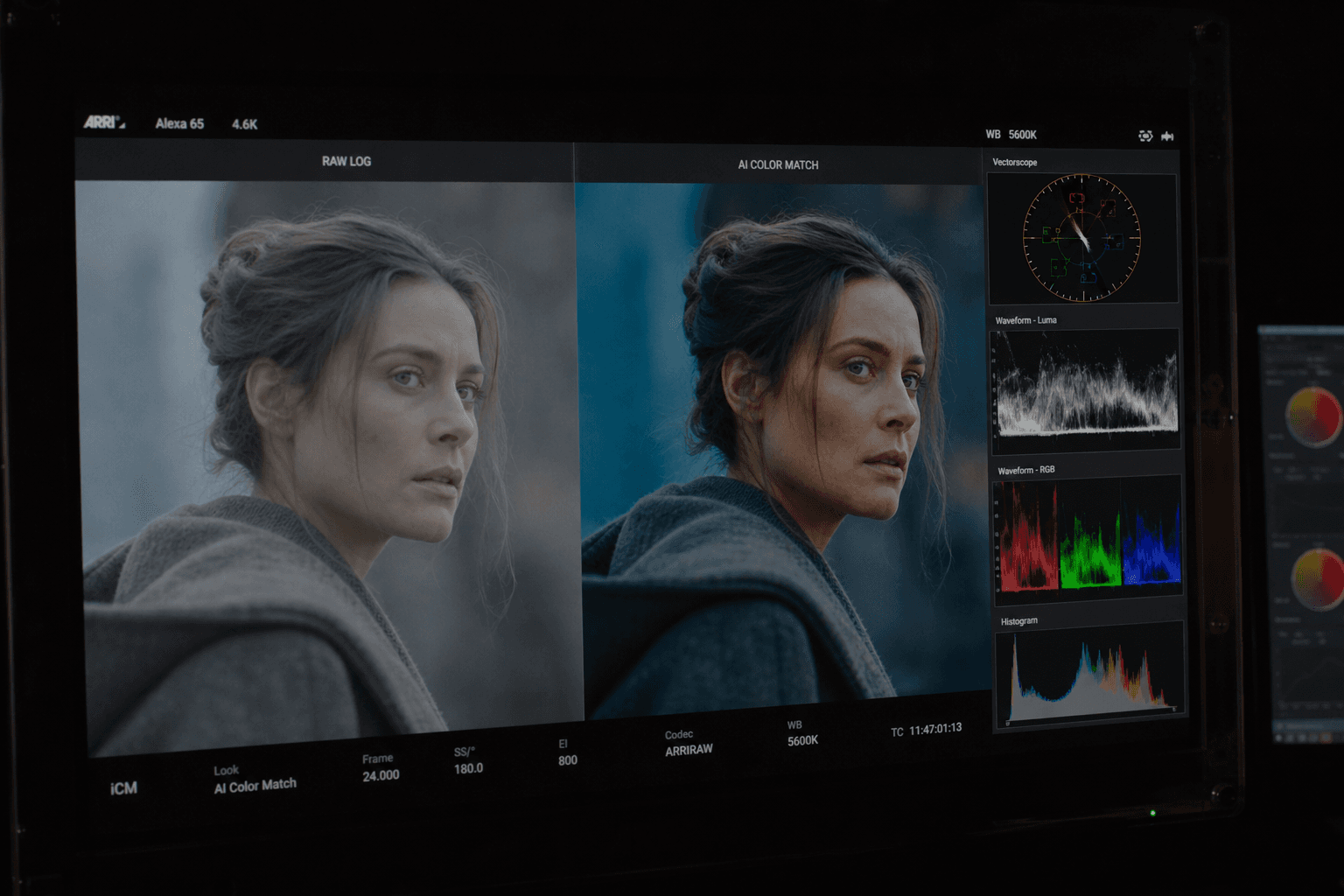

Le premier pilier, c'est corriger avant de styliser. Tant que ton exposition et ta balance globale ne sont pas stables, toute LUT ou look créatif va masquer des problèmes au lieu de les résoudre. Tu verras des ombres qui bouchent, des hautes lumières qui crashent, et des peaux qui partent en magenta ou en vert dès que tu pousses un peu le contraste. L'IA de color match n'est pas magique sur des bases incohérentes. Elle extrapole. Si la base ment, l'extrapolation ment aussi.

Le deuxième pilier, c'est protéger les tons de peau comme juge de paix. Un décor peut accepter une température extrême si c'est une intention. Un visage principal qui devient plastique ou orange casse la croyance du spectateur en quelques secondes. En pratique, tu surveilles la relation entre luminance et chrominance sur les visages. Tu évites les corrections globales qui "réparent" un plan en détruisant un autre dans la même scène.

Le troisième pilier, c'est la continuité de séquence. Un plan magnifique isolé peut ruiner un enchaînement si sa température ou son contraste ne parlent pas le même langage que le plan d'avant. Le cinéma se lit dans la transition. Ton cerveau détecte des micro écarts même quand tu ne sais pas les nommer. L'étalonnage IA aide à rapprocher des plans, mais tu dois valider en lecture continue, pas en capture figée.

Le quatrième pilier, c'est le contrôle par scopes. Parade, vecteurscope, forme d'onde : ce n'est pas du snobisme technique. C'est un antidote à la fatigue visuelle. Après vingt minutes sur une timeline, ton œil s'adapte et te ment. Les scopes restent factuels. Ils t'aident à éviter les excès de saturation sur les rouges, les dérives de peau, et les noirs écrasés qui semblaient "cinéma" sur un écran mais deviennent boue sur un autre.

Le cinquième pilier, souvent oublié, c'est la cohérence texturelle. Deux plans peuvent matcher en couleur et rester incohérents en netteté, bruit, ou compression. Si tu pousses la couleur sur un plan très bruité, le bruit devient une texture dominante. D'où l'intérêt de nettoyer ou de gérer le grain de façon uniforme avant de verrouiller le look. Pour une approche grain et filmicité sur image fixe ou plans sources mixtes, relie ce sujet à notre guide sur l'ajout de grain cinéma à une image IA.

💡 Frank's Cut: avant d'ajouter un look, fixe une règle simple : aucune décision créative qui dégrade la lisibilité du regard sur tes plans de dialogue. Tu peux assombrir le monde, pas les yeux.

The trench workflow : pipeline étalonnage IA fiable

Tu démarres par une phase de normalisation. Toutes les sources doivent parler le même langage de base : espace de travail, niveaux de référence, gestion du LOG si tu en as. Sans ça, l'IA fera des sauts étranges entre plans. Si tu mélanges du Rec.709, du LOG caméra, et des exports IA "bruts", tu dois d'abord aligner vers un étalon intermédiaire compréhensible pour toi.

Ensuite tu identifies les plans pivots : ceux qui portent l'émotion principale d'une scène et qui ont une lumière représentative. Tu balances ces plans à la main. Ils deviennent la cible vers laquelle tu ramènes le reste. C'est plus stable que de demander à l'outil de deviner une intention globale sur un bloc hétérogène.

Tu enchaînes avec un color matching par groupes. Même lieu, même heure, même type de source : tu traites en lots cohérents. Évite le bouton magique sur tout le film. Tu veux de la proximité statistique entre images comparables. Entre deux groupes, tu fais une passe de pont manuelle pour éviter les ruptures.

Tu termines par un style créatif léger et une passe de contrôle global : vignettage très modéré, courbe de contraste finale, sharpening maîtrisé si nécessaire. Puis tu exportes des tests sur plusieurs écrans. Pas pour le plaisir. Pour éviter la surprise sur mobile, où la moitié de ton audience vit souvent.

Pour les projets qui mélangent prises réelles et plans générés, garde une continuité avec notre article sur les erreurs de raccord et d'incohérences visuelles sur un film IA, parce que la couleur ne peut pas réparer un axe faux ou une lumière contradictoire.

Scénario A : court métrage hybride, intérieur nuit, peau sensible

Tu as trois sources : caméra LOG, plan IA intérieur, et stock footage corrigé différemment. Tu normalises tout en espace de travail commun. Tu balances un plan caméra pivot sur le visage principal. Tu lances le match IA sur les autres plans caméra du même bloc. Pour le plan IA, tu n'appliques pas la même courbe aveuglément : tu rapproches d'abord la luminance globale, puis tu corriges la peau avec masque doux. Le stock footage reçoit une passe séparée avant pont. À la fin, tu ajoutes un look unique à faible intensité sur le node final.

Scénario B : clip musical très stylisé, mais peaux présentes

Tu veux du cyan dans les ombres et des hautes lumières chaudes. Tu fais quand même la correction primaire neutre en amont. Tu appliques le look en étage, pas en destruction des médiums. Tu isolés les peaux pour limiter la contamination du teinte split. Tu contrôles le vecteurscope pour éviter que le rouge des lèvres parte en neon. Tu ajoutes du grain uniforme en dernier pour lier les sources.

Scénario C : restauration archive + upscaling préalable

Tu as monté après une passe upscaling. Le risque est le halos et le bruit menteur. Tu nettoies légèrement avant étalonnage, puis tu évites les sharpness agressifs. Le color match IA aide à harmoniser des archives de sources différentes, mais tu dois surveiller les transitions de peau sur les visages historiques. Pour la chaîne complète, notre guide upscaling vidéo vers 4K reste le complément logique.

Étape 1 : préparer les rushes comme un coloriste de salle

Classe tes plans par scène et par lumière. C'est une discipline ennuyeuse qui te fait gagner des heures. Nettoie le bruit de façon raisonnable avant de monter en contraste, sinon tu amplifies la saleté. Choisis un plan de référence par séquence et écris en une phrase pourquoi il est référence : exposition, émotion, dominance colorimétrique.

Documente aussi tes intentions : froid extérieur, chaud intérieur, puis convergence progressive. Ce petit texte évite de te perdre quand une suggestion IA te propose un résultat séduisant mais hors intention. Si ta lumière est encore floue au moment du storyboard ou de la génération, reviens à la source : notre guide pour décrire la lumière comme un directeur photo dans un prompt t'aide à verrouiller des dominantes et des contrastes avant même la couleur.

Étape 2 : correction primaire, harmonie, et validation peau

Tu règles noir, blanc, et gamma de façon à garder de la matière dans les cheveux et les tissus sans écraser les ombres portées. Tu appliques l'aide IA de match seulement quand un groupe est homogène. Tu valides plan par plan sur les cut points, parce que l'œil voit d'abord les sauts sur les visages.

Tu contrôles les peaux sur vecteurscope avec humilité : ce n'est pas une science militaire, mais un filet de sécurité. Si deux plans ont des peaux crédibles mais des décors différents, c'est souvent acceptable. Si deux plans ont des décors alignés mais des peaux qui changent de famille de teinte, le spectateur sent la triche.

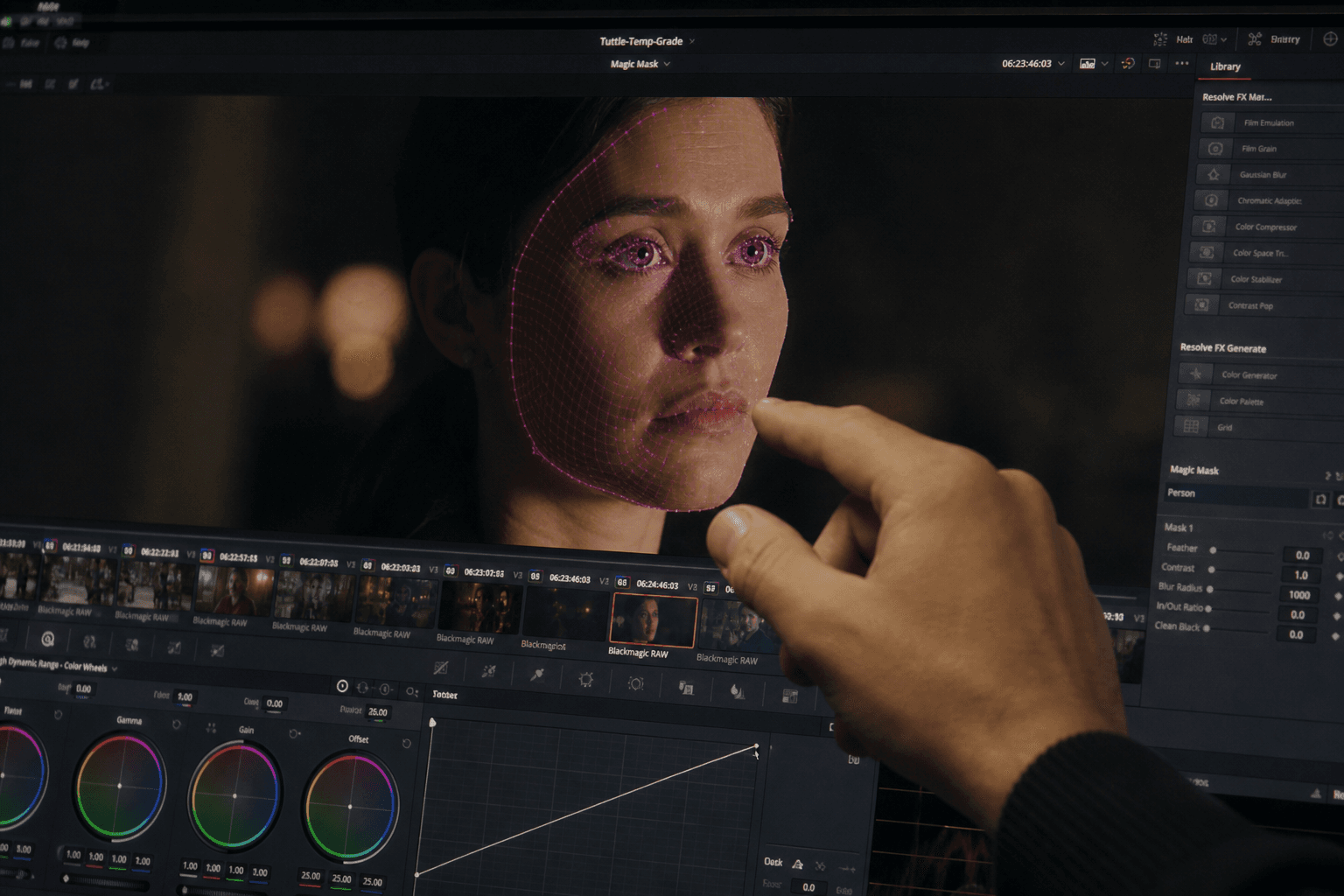

Étape 3 : masques intelligents, look créatif, grain final

Les masques IA de sélection sujet et ciel t'aident à séparer les domaines sans rotoscopie lourde. Utilise-les pour des corrections locales, pas pour sauver un plan mal cadré ou mal éclairé à la base. Le look créatif doit monter en intensité par paliers. Opacity du look à 70% bat souvent 100% sur des scènes réalistes.

Termine par une couche de grain cohérente et un contrôle sharpening très modéré. Les références techniques publiques sur la fabrication et la diffusion d'images professionnelles insistent sur la métrologie et la cohérence d'affichage : l'EBU Tech publie des documents utiles pour comprendre comment les standards de diffusion influencent ce que tu juges sur un écran.

Tableau comparatif : approches d'étalonnage avec ou sans IA

| Approche | Vitesse | Contrôle créatif | Risque principal | Quand la choisir |

|---|---|---|---|---|

| Auto IA seule | Très rapide | Faible | Look générique, peaux instables | Draft, proof interne |

| Manuel pur | Lente | Très élevé | Temps, fatigue œil | Chef-lieu critique |

| Hybride IA + manuel | Rapide à modéré | Élevé | Mauvais groupes sources | Production indépendante |

| LUT unique | Très rapide | Faible | Désastre peau / décors mixtes | Sources déjà parfaites |

| Étage nodes + masques | Modéré | Très élevé | Complexité | Fiction, publicité |

[🎥 WATCH: Check out this breakdown on the Business Dynamite YouTube channel: https://www.youtube.com/@BusinessDynamite - Specifically look at the segment on AI color matching and cinematic grading]

Troubleshooting : ce que les débutants cassent en étalonnage IA

Le premier cas classique, c'est styliser trop tôt. Tu aimes ta LUT, tu l'as mise avant l'équilibrage, et maintenant chaque correction se bat contre elle. Reprends depuis la primaire sans LUT, puis réintroduis le look en faible dose.

Le deuxième cas, c'est ignorer les peaux jusqu'à la fin. Tu te retrouves avec un décor magnifique et des visages qui ressemblent à de la cire. Isole les peaux, réduit l'intensité du look sur cette zone, ou change de LUT.

Le troisième cas, c'est pousser saturation et contraste parce que l'écran semble plat. Souvent le problème vient de la luminance locale ou de la balance, pas de la saturation. Monte la lecture sur scopes avant de compenser à l'œil.

Le quatrième cas, c'est le même preset sur des scènes incompatibles. Un look jungle ne peut pas épouser une scène hôpital sans travail de séparation. Segmenter par intention, pas par facilité.

Le cinquième cas, c'est livrer sans test mobile et téléviseur grand public. Sur téléphone, le gamma perçu change la lisibilité des ombres. Sur TV, le sharpening peut devenir criard. Fais une passe de contrôle rapide, même imparfaite.

Le sixième cas, c'est color match sur tout le film d'un bloc. Tu obtiens une moyenne fade. Reviens à des groupes de plans et des pivots manuels.

Le septième cas, c'est l'excès de netteté numérique après une génération IA. Tu compenses un flou perçu en poussant le sharpening global, et tu obtiens des contours qui crient sur les peaux. Corrige d'abord avec une reconstruction légère ou un resize propre si nécessaire, puis ajoute du sharpening localisé sur les zones qui en bénéficient vraiment, rarement sur tout le cadre.

Le huitième cas, c'est la dérive de white balance entre deux exports. Tu grades une version, puis tu réimportes un nouveau rendu avec un léger shift. Verrouille une référence de gris et de peau sur un plan témoin, et compare avant de poursuivre une longue session.

Pour l'outil, DaVinci Resolve reste une base solide pour apprendre sérieusement le langage des nodes et des scopes. La documentation officielle Blackmagic Design DaVinci Resolve aide à comprendre les fondations sans te perdre dans les modes marketing.

💡 Frank's Cut: si tu n'as le temps que pour trois réglages, fais balance, contraste local des visages, et intensité du look. Ce triplet résout une partie surprenante des problèmes "je ne sais pas pourquoi ça fait cheap".

FAQ

Foire aux questions

Réponses rapides aux questions les plus fréquentes sur cet article.

L'IA peut-elle remplacer un coloriste ?

Non dans le sens direction artistique finale, oui dans le sens accélération et harmonisation technique. Un coloriste expérimenté transforme une intention en système de grades, gère les problèmes de multiples sources, et protège les visages dans des looks agressifs. L'IA t'aide à rapprocher des plans, à proposer des points de départ, et à accélérer des tâches répétitives sur des groupes homogènes. Sur une production où tu es seul, l'hybride est le meilleur compromis : tu laisses l'IA faire le gros du rapprochement, puis tu corriges manuellement les plans pivots et les cut points sensibles. Le résultat tient mieux qu'une auto LUT aveugle, et reste sous ton contrôle créatif.

Quel logiciel pour débuter sérieusement ?

DaVinci Resolve est le choix le plus pédagogique pour les scopes, les nodes, et la gestion de versions. La version gratuite suffit largement pour apprendre. L'important n'est pas d'avoir cent plugins, mais un pipeline stable : normalisation, primaire, secondaire locale, look global, grain, export. Si tu changes d'outil toutes les semaines, tu ne développes pas le réflexe scopes. Une fois le langage acquis, tu peux transférer la logique vers d'autres environnements. Pour les créateurs IA, Resolve aide aussi à intérer des sources hétérogènes sans perdre la tête.

Pourquoi mes peaux deviennent orange après une LUT ?

Parce qu'une LUT est une transformation globale. Elle ne sait pas que ton sujet est une peau. Elle pousse souvent les rouges et les mids d'une façon qui plaisait sur un autre type de plan. La solution passe par une intensité réduite, une primaire plus neutre en amont, ou une isolation des peaux pour les recaler. Parfois, une LUT est simplement incompatible avec ta lumière réelle. Dans ce cas, change de LUT ou construis un look étage par étage. Pense LUT comme inspiration, pas comme bouton final.

Faut-il étalonner avant ou après les VFX ?

Fais une correction primaire raisonnable avant intégration pour que les VFX travaillent sur une image stable, puis finalise le look après composition. Si tu pousses un look extrême avant effets, tu compliques les keying, les intégrations de lumière, et les repères de grain. Après VFX, tu unifies avec une passe globale plus une passe locale sur les plans problématiques. Cette séquence réduit les surprises en fin de chaîne.

Comment savoir si mon image est trop poussée ?

Regarde sur un écran non calibré et sur smartphone. Si les ombres deviennent une plaque sans détail, ou si les peaux perdent leur variation naturelle, tu es trop loin. Utilise aussi les scopes : une saturation qui explose sur le vecteurscope ou des noirs collés au plancher sont des signaux clairs. Quand un spectateur remarque la couleur avant l'émotion, tu es souvent au-delà du seuil utile. Reviens de dix à vingt pour cent en intensité et reteste.

Combien de temps pour un court métrage ?

Avec un workflow hybride propre, une à deux journées peuvent suffire pour un court après montage verrouillé, plus une demi-journée de contrôles exports. Sans méthode, tu peux tripler le temps en allers retours émotionnels. Le facteur clé est la qualité de préparation des sources. Si tu dois réparer dix plans IA incohérents en lumière, l'étalonnage devient du sauvetage. Si tes sources sont propres, l'IA accélère réellement.

Les scopes suffisent-ils sans écran calibré ?

Les scopes t'évitent des erreurs grossières, mais un écran raisonnablement calibré reste important pour le ressenti des mids et des textures fines. Si tu n'as pas de sonde, utilise au moins des profils écran cohérents et des tests multi devices. L'objectif n'est pas la perfection laboratoire sur un budget indie, mais d'éviter les écarts extrêmes. Combine scopes, captures de référence, et lecture continue.

Dois-je travailler en LOG ou en Rec.709 pour l'IA ?

Travaille dans un espace cohérent avec tes sources et ton outil. Si tu ne maîtrises pas encore le LOG, normalise vers un étalon intermédiaire que tu comprends, puis étalonnes. L'erreur fréquente est de mélanger des interprétations différentes sans document clair. Documente tes choix d'input transform et reste stable sur tout le projet.

Continuer la lecture

Distribution de film IA : stratégies pour faire exploser sa visibilité

Plan d'action concret pour distribuer un film IA, activer les bons canaux et transformer un projet terminé en audience réelle, avec un workflow de lancement, des KPI utiles et une FAQ orientée créateurs.

Storyboarding IA : transformer son script en vision cinématographique

Méthode terrain pour storyboarder avec l'IA sans galerie décorative : plans clés, cohérence spatiale, prompts de mise en scène, animatique et erreurs fréquentes.

Comment passer d’un rendu amateur à un rendu cinéma

Décisions de grade, lumière motivée, grain, rythme de plans, et rejet : le cinéma est une discipline de choix, pas un preset.