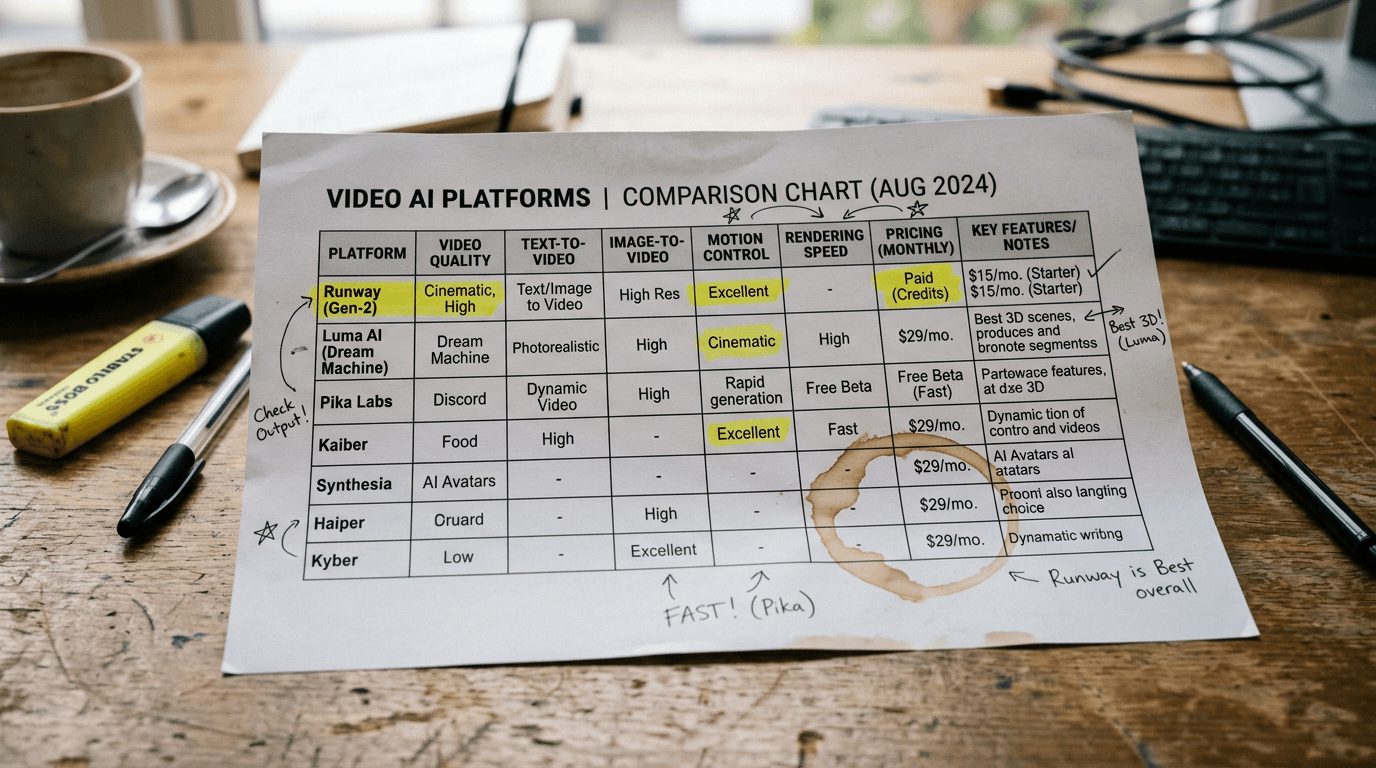

Les meilleurs outils IA vidéo en 2026 : Sora, Runway, Higgsfield, Pika Labs

Comparatif terrain des meilleurs outils IA vidéo 2026: Sora, Runway, Higgsfield et Pika Labs pour produire des plans crédibles sans rendu fake.

Les meilleurs outils IA vidéo en 2026 : Sora, Runway, Higgsfield, Pika Labs

Tu tapes outil ia video, tu vois des clips bluffants, puis tu lances ton premier test et ton plan ressemble à une pub synthétique sans âme. C’est brutal. Et c’est normal. Les démos montrent le meilleur de chaque outil, pas la réalité de production quand tu dois tenir une narration, un style, un budget, et un délai.

J’ai testé sora, runway, higgsfield, pika labs sur des cas concrets: pubs locales, reels narratifs, teasers produit, séquences de court métrage. Je vais te dire ce qui tient en production, ce qui casse, et comment choisir le bon outil selon ton niveau et ton objectif.

Si tu es débutant, retiens ça immédiatement: le meilleur outil IA vidéo n’est pas celui qui fait le plan le plus spectaculaire. C’est celui qui te permet de sortir une séquence cohérente du premier au dernier plan.

Pourquoi la plupart des vidéos IA débutants paraissent fake

Le problème numéro un, c’est l’absence d’intention de plan. Beaucoup génèrent des images animées, pas des plans narratifs. Résultat: mouvement gratuit, cadrage flottant, lumière incohérente.

Le problème numéro deux, c’est la logique “un prompt miracle”. En vidéo, ça ne marche presque jamais. Tu dois penser en séquence: plan 1 intention, plan 2 continuité, plan 3 payoff visuel.

Le problème numéro trois, c’est l’oubli de la physique. Si la lumière change sans raison entre deux frames, le cerveau détecte immédiatement le faux. Même chose pour les matières et les micro-mouvements.

Le problème numéro quatre, c’est l’absence de pipeline post-prod. Une vidéo IA brute est rarement prête à livrer. Il faut timing, cut, sound design, parfois upscale et harmonisation colorimétrique.

Sora: puissant pour la narration visuelle, exigeant sur la direction

sora est impressionnant sur la capacité à produire des séquences riches en ambiance et en continuité apparente. Sur certains usages narratifs, il peut donner des plans très crédibles si ton brief est précis.

Là où Sora devient fort, c’est quand tu décris clairement l’action, le rythme et la dynamique caméra. Si tu restes vague, tu obtiens un résultat joli mais peu contrôlable.

Sa limite en production est souvent l’itération longue si tu cherches un plan très spécifique. Tu dois préparer ton prompt comme un mini brief de tournage: sujet, action, focale implicite, lumière, temporalité.

Pour des projets où la narration prime sur l’effet “template social”, Sora mérite clairement une place en haut de ta shortlist.

Runway: excellent hub de production vidéo IA

runway est redoutable comme environnement de production: génération, retouches, variations, extension, parfois workflow complet autour du plan IA. Pour les créateurs qui veulent avancer vite, c’est un vrai atout.

Son avantage principal est opérationnel. Tu peux enchaîner les tests sans sortir de ton pipeline toutes les cinq minutes. Ce gain de friction est énorme quand tu produis plusieurs plans par semaine.

La qualité brute dépend fortement de ton brief, comme partout. Mais Runway brille souvent sur la capacité à corriger et itérer en contexte de production réelle.

Je le recommande souvent aux profils qui veulent professionnaliser leur chaîne vidéo IA sans multiplier les outils dès le premier mois.

Higgsfield: intéressant pour style et expérimentation, attention à la cohérence

higgsfield attire pour ses résultats stylés et son potentiel créatif sur des esthétiques marquées. Si tu veux tester des directions visuelles fortes, c’est un terrain stimulant.

Le piège est classique: style fort ne veut pas dire narration solide. Tu peux obtenir un plan qui impressionne, puis échouer à maintenir le même langage sur la suite.

Pour utiliser Higgsfield intelligemment, je recommande de le positionner en phase de divergence: exploration de looks, d’ambiances, d’énergie de plan. Puis convergence vers l’outil qui tient mieux la série complète.

C’est un excellent outil créatif quand tu gardes une discipline de continuité.

Pika Labs: rapide pour prototyper, à cadrer pour livrables pro

pika labs est très utile pour aller vite sur des prototypes vidéo, des idées de mouvements, des tests de concepts. En phase d’idéation, le rapport vitesse/plaisir est excellent.

Sa limite arrive quand tu passes en exigence de livraison. Tu dois cadrer fortement ton usage pour éviter les séquences trop “effet IA” et les variations de style non voulues.

Je conseille souvent Pika Labs pour tester un storyboard motion rapidement, puis basculer sur un outil plus stable pour les plans clés finals.

C’est un super laboratoire, moins un pipeline complet autonome sur des projets premium exigeants.

Mon comparatif rapide outil par outil

| Outil | Point fort principal | Limite fréquente | Idéal pour |

|---|---|---|---|

| Sora | narration visuelle riche | itérations coûteuses si brief flou | plans story-driven |

| Runway | pipeline complet et rapide | qualité variable sans direction stricte | production régulière |

| Higgsfield | style créatif fort | cohérence de série fragile | exploration visuelle |

| Pika Labs | prototypage ultra rapide | finition parfois limitée | idéation motion |

Tu peux déjà trancher une bonne partie de tes choix avec ce tableau, mais la vraie décision vient d’un benchmark sur ton cas d’usage.

Le Trench Workflow vidéo IA que j’utilise en prod

Étape 1: écrire la promesse émotionnelle du plan.

Étape 2: décrire l’action en 1 phrase concrète.

Étape 3: définir lumière, rythme, angle caméra.

Étape 4: générer 3 variantes max.

Étape 5: noter lisibilité, mouvement, crédibilité.

Étape 6: corriger une variable, puis verrouiller.

Scénario A, pub restaurant local. Objectif: plan vapeur cuisine crédible. Premier rendu trop propre. Correction: texture matière, micro-irrégularités, lumière latérale plus réaliste. Plan validé au deuxième cycle.

Scénario B, teaser SaaS. Objectif: ambiance premium sans gimmick. Runway a permis d’itérer vite sur le rythme des plans et la continuité colorimétrique.

Pour renforcer la qualité de mouvement avant rendu final, tu peux aussi appliquer notre méthode pour améliorer le réalisme des mouvements en vidéo IA.

Scénario C, clip lifestyle court. Higgsfield excellent en exploration style, puis stabilisation finale sur un pipeline plus orienté cohérence.

La règle d’or: ne pas lancer dix variantes sans but. Une intention claire bat toujours une avalanche d’essais.

💡 Frank's Cut: avant de générer, écris la phrase “ce plan doit faire ressentir…”. Si tu ne peux pas finir cette phrase, tu n’es pas prêt à lancer.

Troubleshooting - What Beginners Break

Erreur 1: confondre animation d’image et mise en scène vidéo.

Erreur 2: ignorer la continuité lumière entre plans.

Erreur 3: multiplier les prompts sans protocole de comparaison.

Erreur 4: valider sans test mobile ni son.

Erreur 5: oublier que le montage fait 50 % de la crédibilité.

Erreur 6: livrer une vidéo brute sans harmonisation finale.

[🎥 WATCH: Check out this breakdown on the Business Dynamite YouTube channel: https://www.youtube.com/@BusinessDynamite - Specifically look at the segment on la construction d’un workflow vidéo IA pro de l’idée au plan final].

Core Concepts pour passer du gadget au filmable

Premier concept: la continuité bat le spectacle. Une séquence cohérente vaut mieux qu’un plan viral isolé.

Deuxième concept: le rythme de plan est narratif. Tu dois penser temps, respiration, et progression.

Troisième concept: le son et le montage transforment la perception de réalisme.

Quatrième concept: un prompt vidéo est un brief de mise en scène, pas une liste d’adjectifs.

Cinquième concept: la validation en contexte final décide de la qualité réelle.

Pour renforcer ta base, relis notre guide pour structurer une vidéo IA comme un vrai film, notre méthode pour rendre une scène IA crédible, notre tutoriel Runway pour animer un plan fixe, et notre workflow complet idée vers film IA.

Cas d’usage business: quel outil choisir selon ton profil

Freelance social content: Runway ou Pika Labs selon délai. Tu privilégies vitesse et nombre de livrables.

Agence créative: duo Sora + Runway. Sora pour plans narratifs forts, Runway pour industrialiser la production.

Créateur solo long format: commence sur Runway pour structure, ajoute Sora sur plans signatures.

Studio expérimental: Higgsfield en divergence, puis outil pipeline pour convergence.

Aucune option n’est universelle. Le meilleur choix est celui qui tient ton rythme de publication sans casser la qualité.

Sources externes utiles

Cas réels détaillés: choix outil par contrainte terrain

Cas 1, créateur solo qui publie trois reels par semaine. Contrainte principale: cadence. Ici, un pipeline centré sur Runway avec templates de prompts et structure de montage fixe donne souvent le meilleur ratio temps/qualité. Le piège est de vouloir réinventer le style à chaque vidéo. En cadence élevée, la cohérence gagne toujours contre la sur-expérimentation.

Cas 2, agence locale qui produit une pub mensuelle premium. Contrainte principale: crédibilité perçue client. Sora peut être utilisé pour les plans signatures qui portent l’émotion, puis Runway pour les versions alternatives et les déclinaisons. Cette combinaison réduit le risque de “tout refaire” à la dernière minute. L’agence sécurise le rendu final tout en gardant de la flexibilité.

Cas 3, e-commerce qui veut humaniser ses lancements produit. Contrainte principale: volume + cohérence. Pika Labs peut servir de laboratoire d’angles et de mouvements, puis une phase de convergence sur un outil plus stable permet de finaliser les plans validés. Le gain vient du tri rapide en amont, pas de la recherche d’un outil universel.

Cas 4, studio créatif orienté expérimentation. Contrainte principale: originalité. Higgsfield devient intéressant pour générer des directions visuelles moins attendues, mais un protocole de continuité est indispensable. Sans ce protocole, les séquences sont fortes individuellement mais fragiles en narration globale.

Cas 5, créateur formation en ligne. Contrainte principale: lisibilité pédagogique. Ici, la sobriété visuelle et la clarté priment sur l’effet spectacle. Un outil stable avec prompts répétables et itérations courtes est souvent supérieur à un rendu trop artistique qui distrait du message.

Si tu veux creuser la logique acquisition client autour de ces formats, regarde aussi notre méthode pour trouver des clients vidéo IA. Pour verrouiller la cohérence inter-plans, complète avec notre guide pour créer des scènes IA cohérentes sur plusieurs plans.

Erreurs avancées qui ruinent les vidéos IA après les premières réussites

Erreur avancée 1: confondre sophistication visuelle et efficacité narrative. Tu peux produire des plans ultra détaillés qui n’expliquent rien. En contenu commercial ou pédagogique, le message doit rester dominant.

Erreur avancée 2: oublier la logique d’enchaînement. Un bon plan A ne garantit pas un bon plan B. Le cut révèle immédiatement les incohérences de lumière, d’échelle et de rythme.

Erreur avancée 3: négliger la phase audio. Une vidéo visuellement correcte peut paraître cheap avec un design sonore faible. En vidéo IA, le son est souvent le facteur de réalisme le plus sous-estimé.

Erreur avancée 4: overfitting de prompt. Tu enrichis tellement le prompt que l’outil devient imprévisible. La simplicité structurée bat souvent les descriptions encyclopédiques.

Erreur avancée 5: absence de bibliothèque de plans validés. Sans archive de prompts, timings, LUT et réglages gagnants, tu perds chaque semaine le bénéfice de ton apprentissage.

Plan de montée en niveau sur 30 jours pour débutant sérieux

Semaine 1: produire dix plans courts avec un seul outil, sans chercher la perfection. Objectif: comprendre relation prompt/mouvement/rendu.

Semaine 2: introduire une grille d’évaluation stricte et réduire les itérations inutiles. Objectif: progresser en qualité perçue.

Semaine 3: construire une mini séquence de trois plans cohérents avec continuité lumière et rythme de montage. Objectif: sortir du plan isolé.

Semaine 4: créer un projet livrable complet avec sound design simple, colorimétrie homogène et export adapté au canal final. Objectif: passer de l’exercice au résultat client ou audience.

Ce plan est volontairement pragmatique. La montée en niveau vient de la répétition structurée, pas de la chasse au dernier modèle du moment.

Checklist finale avant publication d’une vidéo IA

Vérifie la cohérence de lumière entre plans adjacents. Si un cut donne l’impression de changer de planète visuelle sans intention, le spectateur décroche.

Vérifie la lisibilité du sujet principal dans les deux premières secondes. Une belle ambiance ne compense pas un sujet illisible.

Vérifie la continuité de mouvement. Les transitions doivent sembler motivées par la mise en scène, pas par un hasard algorithmique.

Vérifie l’audio en contexte réel: écouteurs, haut-parleur smartphone, laptop. Beaucoup de mixes “ok studio” deviennent faibles sur mobile.

Vérifie l’export final sur la plateforme cible. Un rendu correct en local peut être dégradé après compression sociale.

Cette checklist paraît basique. C’est justement pour ça qu’elle est puissante. Les pros avancent grâce à des fondamentaux exécutés sans exception.

Si tu appliques ce protocole sur dix projets d’affilée, ta qualité moyenne monte mécaniquement. Pas parce que l’outil devient magique, mais parce que ton regard devient précis, rapide et impitoyablement cohérent.

FAQ (PAA Optimization)

-

Quel est le meilleur outil ia video pour débuter en 2026 ?

Pour débuter, Runway est souvent un très bon point d’entrée car il combine génération et itération dans un environnement relativement fluide. Tu peux tester, corriger et progresser sans reconstruire ton pipeline à chaque étape. Pika Labs peut aussi être utile si tu veux prototyper vite et comprendre les bases du mouvement. Le meilleur choix dépend de ton objectif immédiat: apprendre la logique narrative ou produire des clips rapides. Dans tous les cas, commence avec une méthode stricte de comparaison, sinon tu risques de confondre vitesse de génération et qualité de livrable. -

Sora est-il vraiment supérieur aux autres outils vidéo IA ?

Sora peut produire des séquences très impressionnantes, surtout sur des usages narratifs où l’ambiance et la continuité visuelle comptent beaucoup. Mais “supérieur” dépend du contexte de production. Si ton besoin est un pipeline rapide et répétable pour des contenus fréquents, Runway peut être plus rentable. Si tu veux explorer des styles, d’autres outils peuvent aussi être pertinents. Le bon réflexe est de tester sur ton brief réel avec des critères mesurables: cohérence, qualité mouvement, vitesse d’itération, et capacité à tenir une série de plans. -

Comment éviter l’effet fake dans une vidéo générée par IA ?

L’effet fake vient souvent d’une lumière incohérente, d’un mouvement non motivé et d’une absence de continuité entre plans. Pour l’éviter, écris une intention claire par plan, définis une logique de lumière stable, et limite les variations gratuites de caméra. Ensuite, corrige une variable à la fois et valide en mobile plus desktop. Ajoute enfin une passe montage et son cohérente, car le réalisme perçu dépend énormément de l’audio et du rythme. Une vidéo IA crédible est une mise en scène dirigée, pas une génération brute publiée immédiatement. -

Runway suffit-il pour produire des vidéos commerciales ?

Oui, Runway peut suffire dans de nombreux contextes commerciaux, surtout si tu as un workflow clair et une exigence de contrôle en post-production. Il est particulièrement efficace pour produire régulièrement des contenus avec une bonne cadence. Cela dit, sur des plans très signatures, tu peux gagner à combiner Runway avec un autre outil selon la direction créative. Le point clé est de définir ton niveau de qualité attendu avant de lancer les tests. Runway est puissant, mais comme tous les outils, il donne son meilleur avec une méthode de direction précise. -

Pika Labs est-il seulement un outil de prototype ?

Pika Labs est excellent en prototypage rapide, et c’est souvent sa force principale. Cela ne veut pas dire qu’il est limité à cette phase, mais pour des livrables premium complexes, il faut généralement un cadre de finition plus strict. Beaucoup de créatifs l’utilisent pour explorer des idées de plans et verrouiller une intention avant de finaliser ailleurs. Cette stratégie hybride fonctionne très bien en pratique. L’erreur serait de lui demander tout le pipeline sans adaptation. Utilisé au bon endroit, Pika devient un accélérateur redoutable. -

Faut-il choisir un seul outil ia video ou combiner plusieurs ?

Combiner plusieurs outils est souvent la meilleure stratégie en production réelle. Un outil peut être excellent pour la divergence créative, un autre pour la cohérence de série, et un troisième pour la finalisation. L’important est de garder un pipeline lisible avec des rôles clairs. Sans cette structure, la combinaison devient du chaos. Avec elle, tu gagnes en flexibilité et en qualité. La maturité créative, ce n’est pas la fidélité aveugle à un outil. C’est la capacité à orchestrer les bons outils au bon moment. -

Combien de temps faut-il pour sortir une vidéo IA vraiment pro ?

Cela dépend du format, du niveau d’exigence et de ton pipeline, mais une vidéo réellement pro demande presque toujours plus de temps que la génération brute. Le travail invisible, c’est la direction, le tri, la correction, le montage, et la validation finale. Une production sérieuse peut être rapide si ta méthode est solide, mais elle n’est jamais instantanée. Le meilleur moyen d’accélérer est de standardiser ton workflow: intention claire, grille d’évaluation, itérations limitées, et archivage des décisions pour ne pas recommencer à zéro à chaque projet.

Le plan parfait n’existe pas. Le pipeline fiable, si.

Continuer la lecture

Adobe Firefly : test complet, qualité, limites et cas d’usage

Mon test terrain d’Adobe Firefly en 2026: qualité réelle, limites, workflow marketing, comparaison pratique et méthode pour éviter les rendus IA artificiels.

Les meilleures alternatives à Midjourney en 2026

Comparatif terrain des meilleures alternatives Midjourney en 2026: Recraft, Ideogram AI, Leonardo IA, Bing Image Creator, Firefly, Craiyon et Nano Banana.

HeyGen et ElevenLabs : les meilleurs outils IA pour la voix et les avatars ?

Comparatif terrain HeyGen vs ElevenLabs pour créer des voix IA et avatars crédibles en 2026, avec workflow pro, limites réelles et cas d’usage business.